序文

これまでの Web 上のオーディオはかなり未発達なもので、ごく最近まで Flash や QuickTime のようなプラグインを通して配信しなくてはなりませんでした。HTML5 での audio 要素の導入は、基本的なストリーミング・オーディオ再生を可能にする重要なものです。しかし、より複雑なオーディオアプリケーションを扱うには、それだけではまだ充分に強力ではありません。洗練された Web ベースのゲームやインタラクティブ・アプリケーションのためには別の解決策が必要とされます。この仕様では、近年のデスクトップ・オーディオ制作アプリケーションに見られるミキシング、プロセシング、フィルタリング処理に加え、近年のゲームオーディオエンジンに見られるような機能も持たせる事を目標とします。

この API はさまざまな使用例 [webaudio-usecases] を考慮して設計されています。理想的には すべての ユースケースがスクリプトから制御される最適化された C++ エンジンを使って無理なく実装でき、ブラウザーで動作するようにサポートされなくてはなりません。とは言っても、近年のデスクトップ・オーディオソフトウェアは極めて高度な機能を持ち、それらの一部はこのシステムを使ったとしても構築する事が困難か不可能と考えられます。Apple 社の Logic Audio がそのようなアプリケーションの 1 つであり、外部 MIDI コントローラー、任意のプラグイン・オーディオエフェクトやシンセサイザー、高度に最適化されたオーディオファイルのディスクへの読み込み/書き出し、密に統合されたタイムストレッチなどなどをサポートしています。それでもなお、ここで提案するシステムは、音楽に関するものを含めて、かなり複雑なゲームやインタラクティブ・アプリケーションの広い範囲を充分にサポートする事が可能です。またそれは、WebGL によってもたらされる、より高度なグラフィックスの機能をよく引き立たせる事が可能です。このAPIはより高度な機能を後から追加できるように設計されています。

機能

この API は、これらの基本機能をサポートします:

-

単純な、あるいは複雑なミキシング/エフェクト・アーキテクチャーのための モジュラールーティング

-

内部処理に 32 ビット浮動小数を使用した高いダイナミックレンジ

-

非常に高度なリズムの精度を必要とするドラムマシンやシーケンサーなどのアプリケーションのための、低 レイテンシー な サンプル単位の時間精度での音の再生。これには、エフェクトを 動的に生成 できるようにする事も含まれます

-

エンベロープ、フェードイン/フェードアウト、グラニュラーエフェクト、フィルタースイープ、LFO などのためのオーディオパラメーターのオートメーション

-

分割や結合など、オーディオストリームのチャンネルに対する柔軟な扱い

-

getUserMedia()からのMediaStreamを使用したライブオーディオ入力に対する処理 -

WebRTC との統合

-

MediaStreamTrackAudioSourceNodeと [webrtc] を使ってリモート・ピアから受け取ったオーディオの処理 -

生成または加工されたオーディオストリームの

MediaStreamAudioDestinationNodeと [webrtc] を使ったリモート・ピアへの送信

-

-

スクリプトでの直接的 なオーディオストリームの合成および加工

-

3D ゲームや没入環境を幅広くサポートする 空間音響 :

-

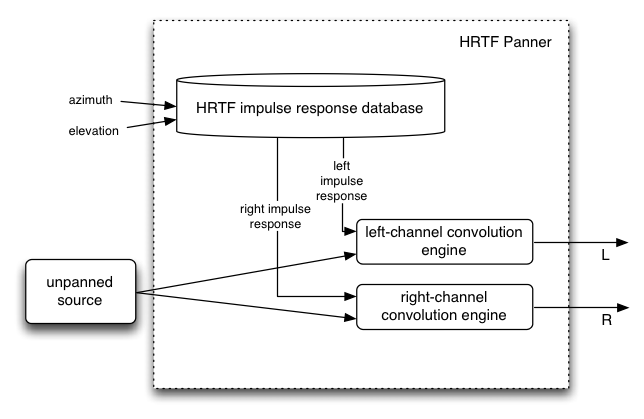

パンニングモデル: 等価パワー, HRTF, パススルー

-

距離減衰

-

サウンドコーン

-

障害物 / 遮蔽物

-

音源 / リスナー

-

-

広範囲の線形エフェクト、特に非常に高い品質のルーム・エフェクトに使用できるコンボリューションエンジン。これによって可能なエフェクトの例を以下に示します:

-

小さい / 大きい部屋

-

大聖堂

-

コンサートホール

-

洞窟

-

トンネル

-

廊下

-

森

-

野外劇場

-

ドア越しの遠くの部屋

-

極端なフィルター

-

風変りな巻き戻し効果

-

極端なコムフィルター効果

-

-

ミックス全体の制御やスウィートニング ( 訳注:ビデオに効果音などをつける MA 作業 ) のためのダイナミック・コンプレッション

-

効率的な双二次フィルターによる、ローパス、ハイパス、その他一般的なフィルター

-

ディストーションやその他の非線形エフェクトのためのウェーブシェイピング・エフェクト

-

オシレーター

モジュラールーティング

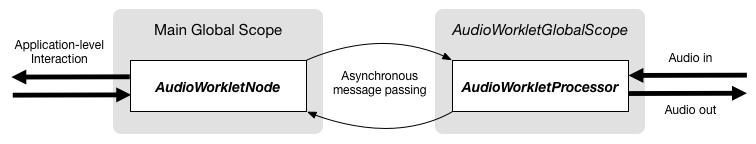

モジュラールーティングによって異なる AudioNode オブジェクト同士を任意に接続できます。それぞれのノードは 入力 および 出力 を持っています。 ソースノード は入力は持たず、ひとつの出力を持ちます。 デスティネーションノード はひとつの入力を持ち、出力は持っていません。フィルターなどの他のノードはソースとデスティネーションの間に配置することができます。2 つのオブジェクトが互いに接続し場合、低レベルのストリーム形式の詳細について開発者が煩わされる事なく、適正な処理が行われます。 例えばもしモノラルの音声ストリームがステレオの入力に接続されていても、左右のチャンネルに 適正 にミックスされます。

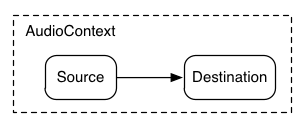

最も単純な例は、ひとつの音声ソースを出力に直接接続したものです。すべての接続は単一の AudioDestinationNode を持つ AudioContext 内部で行われます:

この単純なルーティングを図示します。この例では単一の音を再生しています:

const context= new AudioContext(); function playSound() { const source= context. createBufferSource(); source. buffer= dogBarkingBuffer; source. connect( context. destination); source. start( 0 ); }

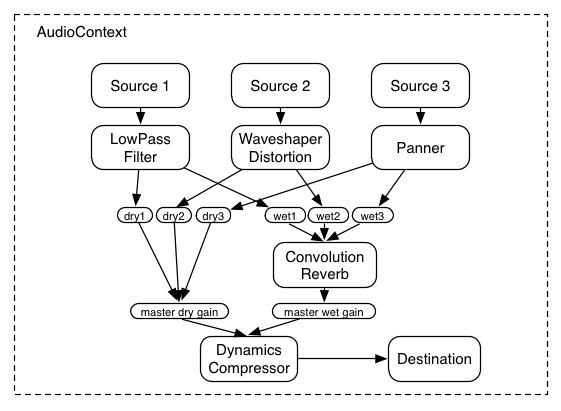

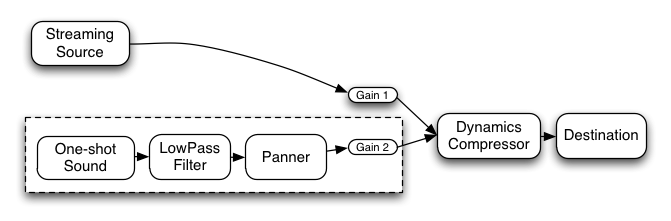

これはもっと複雑な例で、3 つのソースとコンボリューションリバーブが最終出力段にあるダイナミックコンプレッサーを介して送られます:

let context; let compressor; let reverb; let source1, source2, source3; let lowpassFilter; let waveShaper; let panner; let dry1, dry2, dry3; let wet1, wet2, wet3; let mainDry; let mainWet; function setupRoutingGraph() { context= new AudioContext(); // Create the effects nodes. lowpassFilter= context. createBiquadFilter(); waveShaper= context. createWaveShaper(); panner= context. createPanner(); compressor= context. createDynamicsCompressor(); reverb= context. createConvolver(); // Create main wet and dry. mainDry= context. createGain(); mainWet= context. createGain(); // Connect final compressor to final destination. compressor. connect( context. destination); // Connect main dry and wet to compressor. mainDry. connect( compressor); mainWet. connect( compressor); // Connect reverb to main wet. reverb. connect( mainWet); // Create a few sources. source1= context. createBufferSource(); source2= context. createBufferSource(); source3= context. createOscillator(); source1. buffer= manTalkingBuffer; source2. buffer= footstepsBuffer; source3. frequency. value= 440 ; // Connect source1 dry1= context. createGain(); wet1= context. createGain(); source1. connect( lowpassFilter); lowpassFilter. connect( dry1); lowpassFilter. connect( wet1); dry1. connect( mainDry); wet1. connect( reverb); // Connect source2 dry2= context. createGain(); wet2= context. createGain(); source2. connect( waveShaper); waveShaper. connect( dry2); waveShaper. connect( wet2); dry2. connect( mainDry); wet2. connect( reverb); // Connect source3 dry3= context. createGain(); wet3= context. createGain(); source3. connect( panner); panner. connect( dry3); panner. connect( wet3); dry3. connect( mainDry); wet3. connect( reverb); // Start the sources now. source1. start( 0 ); source2. start( 0 ); source3. start( 0 ); }

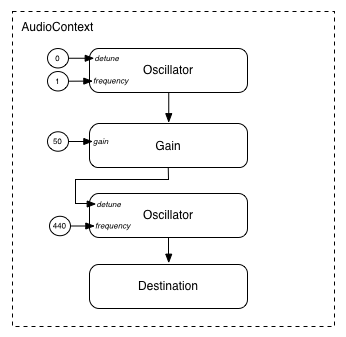

モジュラールーティングはまた AudioNode の出力を 別の AudioNode の動きを制御する AudioParam パラメーターに接続する事もできます。この場合は、ノードからの出力は 入力信号ではなくモジュレーション信号として働きます。

function setupRoutingGraph() { const context= new AudioContext(); // Create the low frequency oscillator that supplies the modulation signal const lfo= context. createOscillator(); lfo. frequency. value= 1.0 ; // Create the high frequency oscillator to be modulated const hfo= context. createOscillator(); hfo. frequency. value= 440.0 ; // Create a gain node whose gain determines the amplitude of the modulation signal const modulationGain= context. createGain(); modulationGain. gain. value= 50 ; // Configure the graph and start the oscillators lfo. connect( modulationGain); modulationGain. connect( hfo. detune); hfo. connect( context. destination); hfo. start( 0 ); lfo. start( 0 ); }

API の概要

定義されているインターフェースは次のとおりです:

-

AudioContext インターフェースは、

AudioNode間の接続を表すオーディオ信号グラフを保持します。 -

AudioNodeインターフェースは、オーディオのソース、オーディオの出力、その間にある処理モジュールを表します。AudioNodeは モジュラー方式 で動的に互いに接続されます。AudioNodeはAudioContextのコンテキスト内に存在します。 -

AnalyserNodeインターフェースは、ミュージックビジュアライザーやその他の視覚化アプリケーションで使用されるAudioNodeです。 -

AudioBufferインターフェースは、メモリー内に保持されるオーディオのリソースで使用されます。これらはワンショットの音、またはもっと長いオーディオクリップを表します。 -

AudioBufferSourceNodeインターフェースは、AudioBuffer からの音を発生するAudioNodeです。 -

AudioDestinationNodeインターフェースは、AudioNodeのサブクラスでオーディオの最終的な出力地点を表します。 -

AudioParamインターフェースは、AudioNodeの個別の機能、例えば音量などを制御します。 -

AudioListenerインターフェースは、PannerNodeと共に空間音響のために使用されます。 -

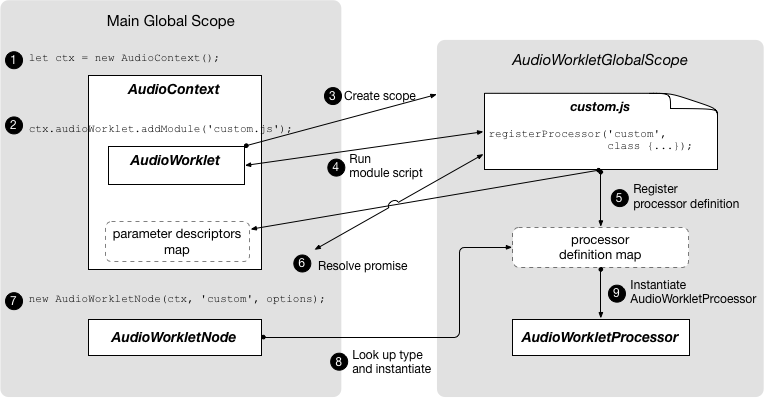

AudioWorkletインターフェースは、スクリプトでオーディオを直接処理するカスタムノードを作成するファクトリーを表します。 -

AudioWorkletGlobalScopeインターフェースは、AudioWorkletProcessor の処理スクリプトが実行されるコンテキストです。 -

AudioWorkletNodeインターフェースは、AudioWorkletProcessor で処理されるAudioNodeを表します。 -

AudioWorkletProcessorインターフェースは、Audio ワーカー内の 1 つのノードのインスタンスを表します。 -

BiquadFilterNodeインターフェースは、次のような一般的な低次のフィルターのAudioNodeです:-

ローバス

-

ハイパス

-

バンドパス

-

ローシェルフ

-

ハイシェルフ

-

ピーキング

-

ノッチ

-

オールパス

-

-

ChannelMergerNodeインターフェースは、複数のオーディオストリームからひとつのオーディオストリームにチャンネルの結合を行うAudioNodeです。 -

ChannelSplitterNodeインターフェースは、ルーティンググラフ内のオーディオストリームの個別のチャンネルにアクセスするために使用されるAudioNodeです。 -

ConstantSourceNodeインターフェースは、AudioParamによる値のオートメーションが可能な定数値を出力するAudioNodeです。 -

ConvolverNodeインターフェースは、( 例えばコンサートホールでの音のような ) リアルタイム線形エフェクトを加えるAudioNodeです。 -

DynamicsCompressorNodeインターフェースは、ダイナミクス・コンプレッションのためのAudioNodeです。 -

IIRFilterNodeインターフェースは、一般的な IIR フィルターのAudioNodeです。 -

MediaElementAudioSourceNodeインターフェースは、audio、videoその他のメディア要素を音源とするAudioNodeです。 -

MediaStreamAudioSourceNodeインターフェースは、ライブオーディオ入力やリモート・ピアから受け取ったようなMediaStreamを音源とするAudioNodeです。 -

MediaStreamTrackAudioSourceNodeインターフェースは、MediaStreamTrackからのオーディオを音源とするAudioNodeです。 -

MediaStreamAudioDestinationNodeインターフェースは、リモート・ピアに送信するMediaStreamを出力先とするAudioNodeです。 -

PannerNodeインターフェースは、3D 空間での空間音響/空間定位のためのAudioNodeです。 -

PeriodicWaveインターフェースは、OscillatorNodeで使用されるカスタム周期波形を指定するために使用されます。 -

OscillatorNodeインターフェースは、周期的な波形を発生するAudioNodeです。 -

StereoPannerNodeインターフェースは、ステレオストリームで 入力された信号の equal-power 方式の定位を行うAudioNodeです。 -

WaveShaperNodeインターフェースは、ディストーションやその他微妙なウォーミング効果 ( 訳注:いわゆるサチュレーション効果の事 ) など、非線形のウェーブシェイピング・エフェクトを加えるためのAudioNodeです。

また、Web Audio API で既に非推奨とされましたがまだ削除されておらず、置き換えの実装が予定されているいくつかの機能があります。

-

ScriptProcessorNodeインターフェースは、スクリプトでオーディオを直接生成または処理するためのAudioNodeです。 -

AudioProcessingEventインターフェースは、ScriptProcessorNodeオブジェクトと共に用いられるイベントタイプです。

1. オーディオ API

1.1. BaseAudioContext インターフェース

Opera43+Edge79+

Edge (Legacy)NoneIENone

Firefox for Android53+iOS SafariNoneChrome for Android56+Android WebView56+Samsung Internet6.0+Opera Mobile43+

このインターフェースは AudioNode オブジェクトのセットとそれらの接続を表します。それによって AudioDestinationNode に任意の信号をルーティングする事を可能にします。ノードはコンテキストから作成され、お互いに 接続 されます。

BaseAudioContext は直接的にはインスタンス化されず、代わりに AudioContext (リアルタイムレンダリングの場合)と OfflineAudioContext (オフラインレンダリングの場合)が拡張された具体的なインターフェースとなっています。

BaseAudioContext は、初期状態では空のプロミスの順序付きリストである [[pending promises]] という内部スロットを持って作成されます。

各 BaseAudioContext は、固有の メディア要素イベントタスクソース を持っています。 さらに BaseAudioContext には AudioContextState から値を取得する2つのプライベートスロット [[レンダリングスレッドの状態]] と [[制御スレッドの状態]] があり、どちらも最初は "suspended" に設定されています。

enum {AudioContextState "suspended" ,"running" ,"closed" };

| 列挙値の説明 | |

|---|---|

"suspended"

| このコンテキストは現在中断しています ( コンテキストの時間は進まず、オーディオハードウェアはパワーダウン / 解放されている可能性もあります)。 |

"running"

| オーディオは処理状態にあります。 |

"closed"

| このコンテキストは解放され、もうオーディオ処理に使用できません。すべてのシステムオーディオリソースは解放されました。 |

callback DecodeErrorCallback =undefined (DOMException );error callback DecodeSuccessCallback =undefined (AudioBuffer ); [decodedData Exposed =Window ]interface :BaseAudioContext EventTarget {readonly attribute AudioDestinationNode destination ;readonly attribute float sampleRate ;readonly attribute double currentTime ;readonly attribute AudioListener listener ;readonly attribute AudioContextState state ; [SameObject ,SecureContext ]readonly attribute AudioWorklet audioWorklet ;attribute EventHandler onstatechange ;AnalyserNode createAnalyser ();BiquadFilterNode createBiquadFilter ();AudioBuffer createBuffer (unsigned long ,numberOfChannels unsigned long ,length float );sampleRate AudioBufferSourceNode createBufferSource ();ChannelMergerNode createChannelMerger (optional unsigned long numberOfInputs = 6);ChannelSplitterNode createChannelSplitter (optional unsigned long numberOfOutputs = 6);ConstantSourceNode createConstantSource ();ConvolverNode createConvolver ();DelayNode createDelay (optional double maxDelayTime = 1.0);DynamicsCompressorNode createDynamicsCompressor ();GainNode createGain ();IIRFilterNode createIIRFilter (sequence <double >,feedforward sequence <double >);feedback OscillatorNode createOscillator ();PannerNode createPanner ();PeriodicWave createPeriodicWave (sequence <float >,real sequence <float >,imag optional PeriodicWaveConstraints = {});constraints ScriptProcessorNode createScriptProcessor (optional unsigned long bufferSize = 0,optional unsigned long numberOfInputChannels = 2,optional unsigned long numberOfOutputChannels = 2);StereoPannerNode createStereoPanner ();WaveShaperNode createWaveShaper ();Promise <AudioBuffer >decodeAudioData (ArrayBuffer ,audioData optional DecodeSuccessCallback ?,successCallback optional DecodeErrorCallback ?); };errorCallback

1.1.1. 属性

-

Firefox76+SafariNoneChrome66+

OperaYesEdge79+

Edge (Legacy)NoneIENone

Firefox for Android79+iOS SafariNoneChrome for Android66+Android WebView66+Samsung Internet9.0+Opera MobileYesaudioWorklet, AudioWorklet 型, readonly -

[HTML] と

AudioWorkletのアルゴリズムにより定義されたAudioWorkletProcessorクラスのスクリプトをインポート可能なWorkletオブジェクトへのアクセスを行います。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+currentTime, double 型, readonly -

コンテキストのレンダリンググラフで最後に処理されたオーディオブロックの最後のサンプルフレームの次のサンプルフレームを秒で表した時刻です。もしコンテキストのレンダリンググラフがまだオーディオブロックを処理していない場合

currentTimeは 0 になります。currentTimeの時間軸で 0 はグラフで処理される最初のブロックの最初のサンプルフレームに対応します。このシステムの経過時間はBaseAudioContextが生成するオーディオストリームの経過時間に対応し、それはシステム内の他の時計には同期しないかも知れません。(OfflineAudioContextでは、ストリームはどのデバイスでも能動的に再生されないため、実時間とはまったく違う進み方になります )Web Audio API のすべてのスケジュールされた時刻は

currentTimeに対する相対値になります。BaseAudioContextが "running" 状態にあるとき、この属性の値は単調増加し、レンダリングスレッドにより 1 レンダリング量子 に対応する均一な増分で更新されます。そのため動作中のコンテキストでは、currentTimeはシステムがオーディオブロックを処理するに従って徐々に増加し、常に次に処理されるオーディオブロックの先頭の時刻を表します。それはまた現在の状態に対する変更が効力を持つ最も早い時刻でもあります。currentTimeは制御スレッドが処理を戻すまでに アトミック に読み取られなくてはなりません ( MUST )。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+destination, AudioDestinationNode 型, readonly -

AudioDestinationNodeは単一の入力を持ち、すべてのオーディオの最終的な出口を表しています。通常これは実際のオーディオハードウェアを表します。動作中のすべてのAudioNodeは直接または間接的にこのdestinationに接続されます。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+listener, AudioListener 型, readonly -

AudioListenerは 3D 空間音響 で使用されます。 -

BaseAudioContext/onstatechange

In all current engines.

Firefox40+Safari9+Chrome43+

OperaYesEdge79+

Edge (Legacy)14+IENone

Firefox for Android40+iOS Safari9+Chrome for AndroidYesAndroid WebViewYesSamsung InternetYesOpera MobileYesonstatechange, EventHandler 型 -

BaseAudioContextに AudioContext の状態が変化したとき ( 例えば、対応する Promise がリゾルブされたときなど ) にディスパッチされるイベントのEventHandlerを設定するために使用されるプロパティです。 AudioContext の状態を直接問い合わせる事ができるEvent型のイベントがイベントハンドラーに発行されます。 新たに作成された AudioContextは 常にsuspended状態から開始し、状態の変化イベントは異なる状態への遷移の度に発行されます。このイベントはoncompleteイベントが発行される前に発行されます。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+sampleRate, float 型, readonly -

BaseAudioContextが扱うオーディオのサンプルレート ( 1 秒あたりのサンプルフレーム数 ) です。コンテキスト内のすべてのAudioNodeはこのレートで動作する事を想定しています。これを想定するため、サンプレートコンバータや " 可変速 " 処理はリアルタイム処理内ではサポートされません。 ナイキスト周波数 はこのサンプルレートの半分の値となります。 -

In all current engines.

Firefox40+Safari9+Chrome43+

OperaYesEdge79+

Edge (Legacy)14+IENone

Firefox for Android40+iOS Safari9+Chrome for AndroidYesAndroid WebViewYesSamsung InternetYesOpera MobileYesstate, AudioContextState 型, readonly -

BaseAudioContextの現在の状態を表します。その値は[[制御スレッドの状態]]と同じです。

1.1.2. メソッド

-

BaseAudioContext/createAnalyser

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createAnalyser() -

AnalyserNodeの ファクトリーメソッド です。パラメーターなし。戻り値:AnalyserNode -

BaseAudioContext/createBiquadFilter

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createBiquadFilter() -

いくつかの一般的なフィルタータイプに設定可能な 2 次フィルターを表す

BiquadFilterNodeの ファクトリーメソッド です。パラメーターなし。戻り値:BiquadFilterNode -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createBuffer(numberOfChannels, length, sampleRate) -

与えられたサイズの AudioBuffer を作成します。バッファ内のデータは 0 ( 無音 ) で初期化されます。もし、引数のどれかが負、0 または範囲外の場合、

NotSupportedError例外を発生します ( MUST )。BaseAudioContext.createBuffer() メソッドの引数。 パラメーター 型 Null可 省略可 説明 numberOfChannelsunsigned long ✘ ✘ バッファが持つチャンネル数を指定します。実装は少なくとも 32 チャンネルをサポートしなくてはなりません ( MUST )。 lengthunsigned long ✘ ✘ バッファのサイズをサンプルフレーム数で指定します。これは少なくとも 1 でなくてはなりません ( MUST )。 sampleRatefloat ✘ ✘ バッファ内の リニア PCM オーディオデータのサンプルレートを秒あたりのサンプルフレーム数で表します。実装は少なくとも 8000 から 96000 の範囲をサポートしなくてはなりません ( MUST )。 戻り値:AudioBuffer -

BaseAudioContext/createBufferSource

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createBufferSource() -

AudioBufferSourceNodeの ファクトリーメソッド です。パラメーターなし。 -

BaseAudioContext/createChannelMerger

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createChannelMerger(numberOfInputs) -

チャンネルマージャーを表す

ChannelMergerNodeの ファクトリーメソッド です。numberOfInputsが 1 より小さいかサポートされる数より大きい場合はIndexSizeError例外を発生します ( MUST )。BaseAudioContext.createChannelMerger(numberOfInputs) メソッドの引数。 パラメーター 型 Null可 省略可 説明 numberOfInputsunsigned long ✘ ✔ 入力の数を指定します。値は 32 までサポートされなくてはなりません ( MUST )。もし指定されない場合は 6となります。戻り値:ChannelMergerNode -

BaseAudioContext/createChannelSplitter

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createChannelSplitter(numberOfOutputs) -

チャンネルスプリッターを表す

ChannelSplitterNodeの ファクトリーメソッド です。numberOfOutputsが 1 より小さいかサポートされる数より大きい場合は、IndexSizeError例外を発生します ( MUST )。BaseAudioContext.createChannelSplitter(numberOfOutputs) メソッドの引数 パラメーター 型 Null可 省略可 説明 numberOfOutputsunsigned long ✘ ✔ 出力の数を指定します。値は 32 までサポートされなくてはなりません ( MUST )。もし指定されない場合は 6となります。戻り値:ChannelSplitterNode -

BaseAudioContext/createConstantSource

Firefox52+SafariNoneChrome56+

Opera43+Edge79+

Edge (Legacy)NoneIENone

Firefox for Android52+iOS SafariNoneChrome for Android56+Android WebView56+Samsung Internet6.0+Opera Mobile43+createConstantSource() -

ConstantSourceNodeの ファクトリーメソッド です。パラメーターなし。戻り値:ConstantSourceNode -

BaseAudioContext/createConvolver

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createConvolver() -

ConvolverNodeの ファクトリーメソッド です。パラメーターなし。戻り値:ConvolverNode -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createDelay(maxDelayTime) -

DelayNodeの ファクトリーメソッド です。初期化時のデフォルト遅延時間は 0 秒です。BaseAudioContext.createDelay(maxDelayTime) メソッドの引数 パラメーター 型 Null可 省略可 説明 maxDelayTimedouble ✘ ✔ 遅延機能の遅延時間の最大値を秒で指定します。指定する場合は、その値は 0 よりも大きく 3 分よりも小さくなければなりません ( MUST )。そうでない場合 NotSupportedError例外を発生します ( MUST )。 指定しない場合は1となります。戻り値:DelayNode -

BaseAudioContext/createDynamicsCompressor

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createDynamicsCompressor() -

DynamicsCompressorNodeの ファクトリーメソッド です。パラメーターなし。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createGain() -

GainNodeの ファクトリーメソッド です。パラメーターなし。戻り値:GainNode -

BaseAudioContext/createIIRFilter

Firefox50+SafariNoneChrome49+

OperaYesEdge79+

Edge (Legacy)14+IENone

Firefox for Android50+iOS SafariNoneChrome for Android49+Android WebView49+Samsung Internet5.0+Opera MobileYescreateIIRFilter(feedforward, feedback) -

BaseAudioContext.createIIRFilter() メソッドの引数 パラメーター 型 Null可 省略可 説明 feedforwardsequence<double> ✘ ✘ IIR フィルターの伝達関数のフィードフォワード ( 分子 ) の係数の配列です。この配列の最大の長さは 20 です。もしすべての値が 0 の場合、 InvalidStateError例外を発生します ( MUST )。 配列の長さが 0 または 20 より大きい場合は NotSupportedError 例外を発生します ( MUST )。feedbacksequence<double> ✘ ✘ IIR フィルターの伝達関数のフィードバック ( 分母 ) の係数の配列です。この配列の最大の長さは20です。もし配列の最初の要素が 0 の場合、 InvalidStateError例外を発生します ( MUST )。 もし配列の長さが 0 または 20 より大きい場合はNotSupportedError例外を発生します ( MUST )。戻り値:IIRFilterNode -

BaseAudioContext/createOscillator

In all current engines.

Firefox25+Safari6+Chrome20+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android25+Android WebView37+Samsung Internet1.5+Opera Mobile14+createOscillator() -

OscillatorNodeの ファクトリーメソッド です。パラメーターなし。戻り値:OscillatorNode -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createPanner() -

PannerNodeの ファクトリーメソッド です。パラメーターなし。戻り値:PannerNode -

BaseAudioContext/createPeriodicWave

In all current engines.

Firefox25+Safari8+Chrome59+

Opera17+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari8+Chrome for Android59+Android WebView59+Samsung Internet7.0+Opera Mobile18+createPeriodicWave(real, imag, constraints) -

PeriodicWaveを作成する ファクトリーメソッド です。このメソッドを呼び出したとき、以下の手順が実行されます:-

もし

realとimagが同じ長さでない場合、IndexSizeErrorが発生します ( MUST )。 -

o を

PeriodicWaveOptions型の新しいオブジェクトとします。 -

このファクトリーメソッドに各々渡された

realおよびimagパラメーターを、o の同じ名前の属性として設定します。 -

o の

disableNormalization属性を、ファクトリーメソッドに渡されたconstraints属性のdisableNormalizationの値に設定します。 -

このファクトリーメソッドが呼ばれた

BaseAudioContextを最初の引数とし、o を渡して新しいPeriodicWavep を作成します。 -

p を返します。

BaseAudioContext.createPeriodicWave() メソッドの引数 パラメーター 型 Null可 省略可 説明 realsequence<float> ✘ ✘ コサインパラメーターの数値列です。詳細の説明についてはコンストラクタの引数 realを参照してください。imagsequence<float> ✘ ✘ サインパラメーターの数値列です。詳細の説明についてはコンストラクタの引数 imagを参照してください。constraintsPeriodicWaveConstraints ✘ ✔ 指定されていない場合は、波形は正規化されます。そうでない場合、波形は constraintsに与えられた値に従って正規化されます。戻り値:PeriodicWave -

createScriptProcessor(bufferSize, numberOfInputChannels, numberOfOutputChannels)-

ScriptProcessorNodeの ファクトリーメソッド です。このメソッドは廃止予定 ( DEPRECATED ) で、AudioWorkletNodeで置き換えられます。 スクリプトによるオーディオデータ直接処理のためのScriptProcessorNodeを作成します。bufferSizeまたはnumberOfInputChannelsまたはnumberOfOutputChannelsが範囲外の場合、IndexSizeError例外を発生します ( MUST )。numberOfInputChannelsとnumberOfOutputChannelsの両方を 0 にはできません。この場合、IndexSizeError例外を発生します ( MUST )。BaseAudioContext.createScriptProcessor(bufferSize, numberOfInputChannels, numberOfOutputChannels) メソッドの引数 パラメーター 型 Null可 省略可 説明 bufferSizeunsigned long ✘ ✔ bufferSizeパラメーターはサンプルフレーム数でバッファのサイズを指定します。もしそれが渡されない場合、または値が 0 である場合、実装はノードのライフタイムを通して一定な、動作環境に最適な2の累乗のバッファサイズを選択します。それ以外の場合は明示的にバッファサイズを指定します。それは次の値のどれかでなければなりません: 256、512、1024、2048、4096、8192、16384 ( MUST )。この値はonaudioprocessイベントが発生する頻度とそれぞれの呼び出しでどれだけのサンプルフレームを処理する必要があるかを制御します。bufferSizeが小さい値ならば レイテンシー は低く ( 良く ) なります。オーディオが途切れ、グリッジ が発生する事を避けるには大きな値が必要となります。レイテンシー とオーディオ品質の間のバランスを取るためには、プログラマーはこのバッファサイズを指定せず、実装に最適なバッファサイズを選択させる事が推奨されます。もしこのパラメーターの値が上に示した許された 2 の累乗の値でない場合、IndexSizeError例外を発生します ( MUST )。numberOfInputChannelsunsigned long ✘ ✔ このパラメーターはこのノードの入力チャンネル数を指定します。デフォルトの値は 2 です。32 チャンネルまでの値がサポートされなくてはなりません。チャンネル数がサポート外の場合、 NotSupportedError例外を発生します。numberOfOutputChannelsunsigned long ✘ ✔ このパラメーターはこのノードの出力チャンネル数を指定します。デフォルトの値は 2 です。32 チャンネルまでの値がサポートされなくてはなりません。チャンネル数がサポート外の場合、 NotSupportedError例外を発生します。戻り値:ScriptProcessorNode -

BaseAudioContext/createStereoPanner

Firefox37+SafariNoneChrome42+

OperaNoneEdge79+

Edge (Legacy)12+IENone

Firefox for Android37+iOS SafariNoneChrome for AndroidYesAndroid WebViewYesSamsung InternetYesOpera MobileNonecreateStereoPanner() -

StereoPannerNodeの ファクトリーメソッド です。パラメーターなし。戻り値:StereoPannerNode -

BaseAudioContext/createWaveShaper

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createWaveShaper() -

非線形な歪み効果を表す

WaveShaperNodeの ファクトリーメソッド です。パラメーターなし。戻り値:WaveShaperNode -

BaseAudioContext/decodeAudioData

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+decodeAudioData(audioData, successCallback, errorCallback) -

ArrayBuffer内にあるオーディオファイルのデータを非同期にデコードします。ArrayBufferは、例えばXMLHttpRequestでresponseTypeに"arraybuffer"を指定した場合のresponse属性としてロードされます。オーディオファイルデータはaudio要素でサポートされるどのフォーマットでも構いません。decodeAudioData()に渡されるバッファは [mimesniff] で説明される手順で判定されるコンテントタイプを持ちます。この関数の基本的なインターフェースの手段は戻り値の promise ではありますが、歴史的な理由からコールバックのパラメーターも提供されています。

decodeAudioDataが呼ばれたとき、制御スレッド上では次の手順を実行します ( MUST ):-

this に 対応するグローバルオブジェクト に 関連付けられたドキュメント が 完全にアクティブ でない場合は、 "

InvalidStateError"DOMExceptionで promise をリジェクト して返します。 -

promise を新しい Promise とします。

-

もし

audioDataに対する、IsDetachedBuffer([ECMASCRIPT] で説明されています) がfalseの場合、次の手順を実行します:-

promise を

[[pending promises]]に追加します。 -

audioDataArrayBufferを Detach します。この操作は [ECMASCRIPT] で説明されています。もしこの操作に失敗した場合はステップ 3 にジャンプします。 -

別のスレッドで実行されるデコード処理をキューにいれます。

-

-

そうでなければ、次の手順を実行します:

-

error を

DataCloneErrorとします。 -

promise を error でリジェクトし、

[[pending promises]]から削除します。 -

errorCallbackを error で呼び出す メディア要素タスクをキューに入れます 。

-

-

promise を返します。

制御スレッド でも レンダリングスレッド でもない、デコーディングスレッドと呼ばれる別のスレッドで実行されるデコード処理がキューに入れられるとき、次の手順が発生します ( MUST )。注:複数回の

decodeAudioDataの呼び出しを処理するため、複数のデコーディングスレッドが並列して走る事もあります。-

can decode を初期状態が true のブーリアンフラグとします。

-

MIME Sniffing §6.2 Matching an audio or video type pattern を用いて、

audioDataの MIME タイプの決定を試みます。もしオーディオまたはビデオのパターンマッチングアルゴリズムがundefinedを返した場合 can decode を false に設定します。 -

もし can decode が true の場合、エンコードされている

audioDataを リニア PCM にデコードを試みます。もし失敗した場合は can decode を false に設定します。 -

もし can decode が

falseの場合、 次の手順を実行するための メディア要素タスクをキューに入れます :-

error を

EncodingErrorという名前のDOMExceptionとします。-

promise を error でリジェクトし、

[[pending promises]]から削除します。

-

-

もし

errorCallbackが存在している場合はerrorCallbackを error で呼び出します。

-

-

そうでなければ:

-

デコードされたリニア PCM の結果を得て、

BaseAudioContextのサンプルレートがaudioDataのサンプルレートと異なっていたらリサンプルを行います。 -

次の手順を実行するための メディア要素タスクをキューに入れます:

-

buffer を最終的な結果 ( 必要ならサンプルレート変換を行った後 ) を保持した

AudioBufferとします。 -

promise を buffer を持ってリゾルブします。

-

もし

successCallbackが存在していればsuccessCallbackを buffer を持って呼び出します。

-

-

BaseAudioContext.decodeAudioData() メソッドの引数 パラメーター 型 Null可 省略可 説明 audioDataArrayBuffer ✘ ✘ 圧縮されたオーディオデータを含む ArrayBuffer です。 successCallbackDecodeSuccessCallback? ✔ ✔ デコードが完了したときに呼び出されるコールバック関数です。コールバック関数の引数は 1 つでデコードされた PCM オーディオデータをあらわす AudioBuffer になります。 errorCallbackDecodeErrorCallback? ✔ ✔ オーディオファイルをデコード中にエラーが起こった場合に呼び出されるコールバック関数です。 戻り値:Promise<AudioBuffer> -

1.1.3. コールバック DecodeSuccessCallback() パラメーター

decodedData,AudioBuffer 型-

デコードしたオーディオデータを保持する AudioBuffer。

1.1.4. コールバック DecodeErrorCallback() パラメーター

error,DOMException 型-

デコード中に発生したエラー。

1.1.5. ライフタイム

AudioContext は一度作成された後、これ以上再生する音がなくなるまで、あるいはページを移動するまで再生を続けます。

1.1.6. 内部検査やシリアライゼーションの基本機能の欠如

Web Audio API は音源のスケジューリングに fire-and-forget アプローチを取っています。つまり、音源ノード は、 AudioContext のライフタイムの間のひとつひとつの音に対応して作成され、明示的にグラフからの削除は行いません。これはシリアライゼーション API とは互換性がなく、そのためシリアライズ可能な固定的なノードのセットもありません。

さらに、内部検査のための API を持つためにはスクリプトの中身のガベージコレクションの監視が必要になります。

1.1.7. BaseAudioContext サブクラスに関連付けられるシステムリソース

サブクラス、 AudioContext と OfflineAudioContext はコストの高いオブジェクトと考えるべきです。これらのオブジェクトの作成には、高プライオリティのスレッドまたは低レイテンシーのシステムオーディオを含み、どちらも消費電力への影響があります。通常は、1 つのドキュメント内に 1 つ以上の AudioContext を作成する事は不必要です。

BaseAudioContext のサブクラスの作成または再開は、そのコンテキストが システムリソースを取得 する事を含みます。このためには AudioContext としてはシステムオーディオのストリームを作成する事も必要です。これらの動作はコンテキストが関連するオーディオグラフから出力の生成を開始する際に処理を戻します。

なお、ユーザーエージェントは実装で定められた最大数の AudioContext を持つ事ができ、それ以上の新しい AudioContext の作成は失敗して、 NotSupportedError 例外を発生します。

プログラマーは suspend および close を使う事で、スレッド、プロセスおよびオーディオストリームを含む システムリソースの解放 を行う事ができます。BaseAudioContext をサスペンドする事で、実装は一部のリソースを解放して後で resume を呼び出したときに再開できるようにします。 AudioContext のクローズによって、実装はすべてのリソースを解放し、再度使用したり再開したりはできなくなります。

注 : これは例えば、定期的なコールバックの呼び出しを待つ事やハードウェアが処理可能になるのを待つ事も含みます。

1.2. AudioContext インターフェース

Opera22+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariNoneChrome for Android35+Android WebView37+Samsung Internet3.0+Opera Mobile22+

このインターフェースは、その AudioDestinationNode がデバイスへのリアルタイム出力によって直接ユーザーに信号が届くオーディオグラフを表します。多くの場合、1 つのドキュメントにつき 1 つの AudioContext が使用されます。

enum {AudioContextLatencyCategory "balanced" ,"interactive" ,"playback" };

| 列挙値の説明 | |

|---|---|

"balanced"

| オーディオ出力のレイテンシーと安定性/消費電力のバランスを取ります。 |

"interactive"

| オーディオ出力のレイテンシーをグリッジが発生しない最小値にする。これがデフォルトになります。 |

"playback"

| オーディオ出力のレイテンシーよりも再生の途切れを起こさない事を優先します。消費電力は最も低くなります。 |

[Exposed =Window ]interface :AudioContext BaseAudioContext {constructor (optional AudioContextOptions contextOptions = {});readonly attribute double baseLatency ;readonly attribute double outputLatency ;AudioTimestamp getOutputTimestamp ();Promise <undefined >resume ();Promise <undefined >suspend ();Promise <undefined >close ();MediaElementAudioSourceNode createMediaElementSource (HTMLMediaElement );mediaElement MediaStreamAudioSourceNode createMediaStreamSource (MediaStream );mediaStream MediaStreamTrackAudioSourceNode createMediaStreamTrackSource (MediaStreamTrack );mediaStreamTrack MediaStreamAudioDestinationNode createMediaStreamDestination (); };

ユーザーエージェントがコンテキストの状態を "suspended" から "running" に移行できる場合、 AudioContext が スタート可能 であると言います。 ユーザーエージェントは、 AudioContext の 関連するグローバルオブジェクト が スティッキーアクティベーション を持っている場合にのみ許可するために、この初期遷移を遅延させることができます。

AudioContext は内部に次のスロットを持っています :

[[suspended by user]]-

コンテキストがユーザーのコードによって中断されているかどうかを表すブーリアンフラグです。 初期値は

falseです。

1.2.1. コンストラクター

-

Firefox25+SafariNoneChrome35+

Opera22+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariNoneChrome for Android35+Android WebView37+Samsung Internet3.0+Opera Mobile22+AudioContext(contextOptions) -

現在の設定オブジェクト の 対応するドキュメント が 完全にアクティブ でない場合は

InvalidStateErrorを発生して、次の手順を中止します。AudioContextを作成する際は、以下の手順を実行します:-

AudioContext上の[[制御スレッドの状態]]をsuspendedに設定します。 -

AudioContext上の[[レンダリングスレッドの状態]]をsuspendedに設定します。 -

[[pending resume promises]]をこのAudioContext上のスロットとし、初期状態を空の promise のリストとします。 -

もし

contextOptionsが与えられていれば、そのオプションを適用します:-

この

AudioContextの内部レイテンシーをlatencyHintの項に書かれているように、contextOptions.に従って設定します。latencyHint -

もし

contextOptions.が指定されていれば、このsampleRateAudioContextのsampleRateをその値に設定します。 そうでなければ、デフォルト出力デバイスのサンプルレートを使用します。 もし選択されたサンプルレートが出力デバイスのサンプルレートと異なる場合、このAudioContextはオーディオ出力を出力デバイスのサンプルレートに合うようにリサンプリングしなくてはなりません ( MUST )。注 : もしリサンプリングが必要とされる場合、AudioContext のレイテンシーに大きな影響があるかも知れません。

-

-

この

AudioContextオブジェクトを返します。

処理を開始するための 制御メッセージ を送るには次の手順を実行します:-

システムリソースの取得 を試みます。もし失敗した場合は以降の手順を中止します。

-

AudioContextの[[レンダリングスレッドの状態]]をrunningに設定します。 -

以下の手順を実行するための メディア要素タスクをキューに入れます :

-

AudioContextのstate属性を "running" に設定します。 -

AudioContextにstatechangeという名前の イベントを発行 するための メディア要素タスクをキューに入れます。

-

注 : 残念ながら、

AudioContextの作成の失敗についてプログラム上の通知をすることはできません。ユーザーエージェントは、デベロッパーツールコンソールのようなログメカニズムにアクセスできる場合、これを知らせるメッセージをログに記録することをお勧めします。AudioContext.constructor(contextOptions) メソッドの引数 パラメーター 型 Null可 省略可 説明 contextOptionsAudioContextOptions ✘ ✔ AudioContextをどのように作成するかをユーザーが指定するオプション。 -

1.2.2. 属性

-

Firefox70+SafariNoneChrome58+

Opera45+Edge79+

Edge (Legacy)NoneIENone

Firefox for AndroidNoneiOS SafariNoneChrome for Android58+Android WebView58+Samsung Internet7.0+Opera Mobile43+baseLatency, double 型, readonly -

これは

AudioContextがAudioDestinationNodeからオーディオサブシステムにオーディオを渡す処理で発生するレイテンシーの秒数を表します。これにはAudioDestinationNodeの出力とオーディオハードウェアの間で発生するかも知れないその他の処理による追加のレイテンシーは含まれず、特にオーディオグラフ自体に発生するレイテンシーは含まれません。例えばもし、オーディオコンテキストが 44.1 kHz で動作しており、

AudioDestinationNodeの実装が内部でダブルバッファリングによる レンダリング量子 の出力処理を行う場合、処理のレイテンシーは、約 \((2\cdot128)/44100 = 5.805 \mathrm{ ms}\) となります。 -

In only one current engine.

Firefox70+SafariNoneChromeNone

OperaNoneEdgeNone

Edge (Legacy)NoneIENone

Firefox for AndroidNoneiOS SafariNoneChrome for AndroidNoneAndroid WebViewNoneSamsung InternetNoneOpera MobileNoneoutputLatency, double 型, readonly -

オーディオ出力処理のレイテンシーの秒数の見積もり。つまり、UA がホストシステムにバッファを再生を要求した時間から、バッファ内の最初のサンプルが実際にオーディオ出力デバイスで処理される時間までの間隔。この後者の時間は、スピーカーやヘッドフォンのような音の信号を発生するデバイスがサンプルの音を発生する時間を指します。

outputLatency属性の値はプラットフォームと接続されているオーディオ出力デバイスに依存します。outputLatency属性の値は接続されているオーディオ出力デバイスが同じである限り、コンテキストのライフタイムを通じて変化する事はありません。もしオーディオ出力デバイスが変化したならば、outputLatency属性の値もそれに従ってアップデートされます。

1.2.3. メソッド

-

In all current engines.

Firefox40+Safari9+Chrome42+

OperaYesEdge79+

Edge (Legacy)14+IENone

Firefox for Android40+iOS Safari9+Chrome for Android43+Android WebView43+Samsung Internet4.0+Opera MobileYesclose() -

AudioContextをクローズし、使用中の システムリソースを解放 します。これは、AudioContextが作成したすべてのオブジェクトを自動的に開放はしませんが、AudioContextのcurrentTimeの進行を止め、オーディオデータの処理を停止します。close が呼ばれたとき、以下の手順が実行されます:-

this に 対応するグローバルオブジェクト に 関連付けられたドキュメント が 完全にアクティブ でない場合は、 "

InvalidStateError"DOMExceptionで promise をリジェクト して返します。 -

promise を新しい Promise とします。

-

もし

AudioContextの[[制御スレッドの状態]]フラグがclosedであった場合、promise をInvalidStateErrorでリジェクトし、これらの手順を中断して promise を返します。 -

AudioContextの[[制御スレッドの状態]]フラグをclosedに設定します。 -

AudioContextをクローズするための 制御メッセージをキューに入れます。 -

promise を返します。

AudioContextをクローズするための 制御メッセージ を実行する事は、 レンダリングスレッド で、以下の手順を実行する事を意味します:-

システムリソースの解放 を試みます。

-

[[レンダリングスレッドの状態]]をsuspendedに設定します。これによりレンダリングは停止します。 -

もしこの 制御メッセージ がドキュメントがアンロードされる反応の途中で実行されているなら、このアルゴリズムを中止します。

この場合、制御スレッドへの通知は必要ありません。 -

以下の手順を実行する メディア要素タスクをキューに入れます :

-

promise をリゾルブします。

-

もし

AudioContextのstate属性が既に "closed" でない場合:-

AudioContextのstate属性を "closed" に設定します。 -

AudioContextでstatechangeという名前の イベントを発行 するための メディア要素タスクをキューに入れます。

-

-

AudioContextがクローズされた場合、AudioContextに接続されているすべてのMediaStreamとHTMLMediaElementはその出力を無視されます。 つまり、これらはもうスピーカーなどの出力デバイスに出力されなくなります。より柔軟な挙動のためには、HTMLMediaElement.captureStream()の使用を検討してください。注 :

AudioContextがクローズされるとき、実装はサスペンドの場合よりも積極的に多くのリソースを解放する事ができます。パラメーターなし。 -

-

AudioContext/createMediaElementSource

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createMediaElementSource(mediaElement) -

指定された

HTMLMediaElementからMediaElementAudioSourceNodeを作成します。 このメソッドの呼び出しにより、HTMLMediaElementからのオーディオの再生はAudioContextの処理グラフに再ルーティングされるようになります。AudioContext.createMediaElementSource() メソッドの引数 パラメーター 型 Null可 省略可 説明 mediaElementHTMLMediaElement ✘ ✘ 再ルーティングされるメディア要素です。 -

AudioContext/createMediaStreamDestination

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)NoneIENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createMediaStreamDestination() -

MediaStreamAudioDestinationNodeを作成します。パラメーターなし。 -

AudioContext/createMediaStreamSource

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+createMediaStreamSource(mediaStream) -

MediaStreamAudioSourceNodeを作成します。AudioContext.createMediaStreamSource() メソッドの引数 パラメーター 型 Null可 省略可 説明 mediaStreamMediaStream ✘ ✘ 音源となるメディアストリームです。 -

AudioContext/createMediaStreamTrackSource

In only one current engine.

Firefox68+SafariNoneChromeNone

OperaNoneEdgeNone

Edge (Legacy)NoneIENone

Firefox for Android68+iOS SafariNoneChrome for AndroidNoneAndroid WebViewNoneSamsung InternetNoneOpera MobileNonecreateMediaStreamTrackSource(mediaStreamTrack) -

MediaStreamTrackAudioSourceNodeを作成します。AudioContext.createMediaStreamTrackSource() メソッドの引数 パラメーター 型 Null可 省略可 説明 mediaStreamTrackMediaStreamTrack ✘ ✘ 音源となる MediaStreamTrackです。 そのkind属性は"audio"でなくてはならず、そうでない場合は、InvalidStateError例外を発生します ( MUST )。 -

AudioContext/getOutputTimestamp

Firefox70+SafariNoneChrome57+

Opera44+Edge79+

Edge (Legacy)NoneIENone

Firefox for AndroidNoneiOS SafariNoneChrome for Android57+Android WebView57+Samsung Internet7.0+Opera Mobile43+getOutputTimestamp() -

コンテキストのオーディオストリームについて、2 つの関連する位置情報を含む新しい

AudioTimestampインスタンスを返します:contextTimeメンバーには、オーディオ出力デバイスによって現在レンダリングされているサンプルフレームの時間 ( つまり出力されているオーディオストリームの位置 ) が含まれます。これにはコンテキストのcurrentTimeと同じ単位と起点を使用します。 そしてperformanceTimeメンバーには、contextTimeに格納された値に対応するサンプルフレームがperformance.now()( [hr-time-3] で説明されています ) と同じ単位および起点で、オーディオ出力デバイスによってレンダリングされる瞬間を推定する時間が含まれます 。コンテキストのレンダリンググラフがまだオーディオブロックを処理していないときに

getOutputTimestampを呼び出すと、両方のメンバーが 0 であるAudioTimestampインスタンスを返します。コンテキストのレンダリンググラフがオーディオブロックの処理を開始すると、その

currentTime属性の値は常にgetOutputTimestampメソッドの呼び出しで取得されるcontextTime値より大きくなります。getOutputTimestampメソッドから返された値は、コンテキストの時刻のわずかに後になるパフォーマンスの時刻の見積もりを得るのに使用できます:function outputPerformanceTime( contextTime) { const timestamp= context. getOutputTimestamp(); const elapsedTime= contextTime- timestamp. contextTime; return timestamp. performanceTime+ elapsedTime* 1000 ; } 上の例での見積もりの精度は、引数の値が現在の出力オーディオストリームの位置にどれほど近いかによって決まります: つまり与えられた

contextTimeがtimestamp.contextTimeに近いほど、得られた推定の精度は良くなります。注 : コンテキストの

currentTimeとgetOutputTimestampメソッドの呼び出しから得られたcontextTimeの値の差は、currentTimeが不均一な時間間隔で増加する可能性があるため、信頼できる出力レイテンシーの見積もりとみなす事はできず、代わりにoutputLatency属性を使用する必要があります。パラメーターなし。戻り値:AudioTimestamp -

In all current engines.

Firefox40+Safari9+Chrome41+

OperaYesEdge79+

Edge (Legacy)14+IENone

Firefox for AndroidYesiOS Safari9+Chrome for Android41+Android WebView41+Samsung Internet4.0+Opera MobileYesresume() -

AudioContextのcurrentTimeの進行が停止している場合、再開させます。resume が呼ばれた時、以下の手順が実行されます :-

this に 対応するグローバルオブジェクト に 関連付けられたドキュメント が 完全にアクティブ でない場合は、 "

InvalidStateError"DOMExceptionで promise をリジェクト します。 -

promise を新しい Promise とします。

-

もし

AudioContextの[[制御スレッドの状態]]がclosedであれば promise はInvalidStateErrorでリジェクトされ、これらの手順は中止して promise を返します。 -

[[suspended by user]]をfalseに設定します。 -

もしこのコンテキストが スタート可能 でない場合 promise を

[[pending promises]]と[[pending resume promises]]に加え、これらの手順を中止して promise を返します。 -

AudioContextの[[制御スレッドの状態]]をrunningに設定します。 -

AudioContextを再開するための 制御メッセージをキューに入れます。 -

promise を返します。

AudioContextを再開するための 制御メッセージ を実行するとは、次の手順を レンダリングスレッド で実行する事を意味します:-

システムリソースの取得 を試みます。

-

AudioContextの[[レンダリングスレッドの状態]]をrunningに設定します。 -

オーディオグラフのレンダリング を開始します。

-

失敗した場合は次の手順を実行するための メディア要素タスクをキューに入れます :

-

[[pending resume promises]]から全ての promise を順番にリジェクトして[[pending resume promises]]を空にします。 -

さらに、これらの promise を

[[pending promises]]から削除します。

-

-

以下の手順を実行するための メディア要素タスクをキューに入れます :

-

[[pending resume promises]]にある全ての promise を順番にリゾルブします。 -

[[pending resume promises]]を空にします。さらに、これらの promise を[[pending promises]]から削除します。 -

promise をリゾルブします。

-

もし

AudioContextのstate属性が既に "running" でない場合 :-

AudioContextのstate属性を "running" に設定します。 -

AudioContextでstatechangeという名前の イベントを発行 するための メディア要素タスクをキューに入れます。

-

-

パラメーターなし。 -

-

In all current engines.

Firefox40+Safari9+Chrome43+

OperaYesEdge79+

Edge (Legacy)14+IENone

Firefox for Android40+iOS Safari9+Chrome for Android43+Android WebView43+Samsung Internet4.0+Opera MobileYessuspend() -

AudioContextのcurrentTimeの進行を中断し、デスティネーションで再生するために既に処理を終えた現在のコンテキストの処理ブロックを再生し、その後システムがオーディオハードウェアの占有を解放できるようにします。 これは一般的に、アプリケーションがしばらくの間AudioContextを必要とせず、一時的に AudioContext に関連付けられた システムリソースを解放 したいことがアプリケーションに分かっているときに役に立ちます。この promise は、フレームバッファが空のとき ( ハードウェアに渡されたとき )、またはコンテキストがすでにsuspended状態のときは即座に ( 副作用なしで ) リゾルブされます。コンテキストがクローズされた場合、promise はリジェクトされます。suspend が呼び出された場合、以下の手順を実行します:-

this に 対応するグローバルオブジェクト に 関連付けられたドキュメント が 完全にアクティブ でない場合は、 "

InvalidStateError"DOMExceptionで リジェクト して promise を返します。 -

promise を新しい Promise とします。

-

もし

AudioContextの[[制御スレッドの状態]]がclosedであれば promise はInvalidStateErrorでリジェクトされ、これらの手順は中止して promise を返します。 -

promise を

[[pending promises]]に追加します。 -

[[suspended by user]]をtrueに設定します。 -

AudioContextの[[制御スレッドの状態]]をsuspendedに設定します。 -

AudioContextをサスペンドするための 制御メッセージをキューに入れます。 -

promise を返します。

AudioContextをサスペンドするための 制御メッセージ を実行する、とは レンダリングスレッド で、以下の手順を実行する事を意味します:-

システムリソースの解放 を試みます。

-

AudioContextのレンダリングスレッドの状態をsuspendedに設定します。 -

以下の手順を実行する メディア要素タスクをキューに入れます :

-

promise をリゾルブします。

-

もし

AudioContextのstate属性が既に "suspended" でない場合:-

AudioContextのstate属性を "suspended" に設定します。 -

AudioContextでstatechangeという名前の イベントを発行 するための メディア要素タスクをキューに入れます。

-

-

AudioContextがサスペンドされている間MediaStreamの出力は無視されます。つまり、メディアストリームのリアルタイム性によって、データは失われます。code class="idl">HTMLMediaElement も同様に、システムが再開されるまでその出力は無視されます。AudioWorkletNodeおよびScriptProcessorNodeは、サスペンド中は処理ハンドラーの呼び出しが止まりますが、コンテキストがリジュームされると再開します。AnalyserNodeでは、ウィンドウ関数の目的そのものにより、データは連続ストリームとみなされます。つまり、resume()/suspend()によってAnalyserNodeのデータストリームに無音は発生しません。特に、AudioContextがサスペンドされているときにAnalyserNodeの関数を繰り返し呼び出した際は、同じデータが返されなければなりません ( MUST )。パラメーターなし。 -

1.2.4. AudioContextOptions

Opera?Edge79+

Edge (Legacy)NoneIENone

Firefox for Android61+iOS SafariNoneChrome for Android60+Android WebView60+Samsung Internet8.0+Opera Mobile?

AudioContextOptions ディクショナリーは AudioContext のユーザー指定のオプションを決めるために使用されます。

dictionary { (AudioContextOptions AudioContextLatencyCategory or double )latencyHint = "interactive";float sampleRate ; };

1.2.4.1. ディクショナリー AudioContextOptions メンバー

-

AudioContextOptions/latencyHint

Firefox61+SafariNoneChrome60+

Opera?Edge79+

Edge (Legacy)NoneIENone

Firefox for Android61+iOS SafariNoneChrome for Android60+Android WebView60+Samsung Internet8.0+Opera Mobile?latencyHint,(AudioContextLatencyCategory または double)型, デフォルト値は"interactive" -

オーディオ出力のレイテンシーと消費電力の間のトレードオフに影響を与える、再生のタイプを指示します。

latencyHintの値は、AudioContextLatencyCategoryから選択する事が推奨されます。ただし、レイテンシーと消費電力をより細かくバランスを取るために、レイテンシーの秒数を double 型で指定することもできます。数値を適切に解釈するのはブラウザーの裁量に委ねられています。実際に使用されるレイテンシーは、 AudioContext のbaseLatency属性によって与えられます。 -

AudioContextOptions/sampleRate

Firefox61+SafariNoneChrome74+

OperaNoneEdge79+

Edge (Legacy)NoneIENone

Firefox for Android61+iOS SafariNoneChrome for Android74+Android WebView74+Samsung Internet11.0+Opera Mobile?sampleRate, float 型 -

作成される

AudioContextのsampleRateをこの値に設定します。サポートされている値はAudioBufferのサンプルレートと同じです。指定されたサンプルレートがサポートされていない場合はNotSupportedError例外を発生します ( MUST )。もし

sampleRateが指定されていない場合、このAudioContextの出力デバイスが推奨するサンプルレートが使用されます。

1.2.5. AudioTimestamp

dictionary {AudioTimestamp double contextTime ;DOMHighResTimeStamp performanceTime ; };

1.2.5.1. ディクショナリー

AudioTimestamp メンバー

contextTime, double 型-

BaseAudioContext の

currentTimeの時間軸内の時刻を表します。 performanceTime, DOMHighResTimeStamp 型-

Performanceインターフェースの実装における時間軸内の時刻を表します ( [hr-time-3] で説明されています )。

1.3. OfflineAudioContext インターフェース

Opera22+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariNoneChrome for Android35+Android WebView4.4.3+Samsung Internet3.0+Opera Mobile22+

OfflineAudioContext は、レンダリング/ミックスダウンのための特殊なタイプの BaseAudioContext で、( 潜在的には ) リアルタイムよりも高速に動作します。これはオーディオハードウェアに対してレンダリングせず、可能な限り高速にレンダリングした結果を AudioBuffer に格納して promise を返します。

[Exposed =Window ]interface :OfflineAudioContext BaseAudioContext {constructor (OfflineAudioContextOptions contextOptions );constructor (unsigned long numberOfChannels ,unsigned long length ,float sampleRate );Promise <AudioBuffer >startRendering ();Promise <undefined >resume ();Promise <undefined >suspend (double );suspendTime readonly attribute unsigned long length ;attribute EventHandler oncomplete ; };

1.3.1. コンストラクター

-

OfflineAudioContext/OfflineAudioContext

Firefox53+SafariNoneChrome35+

Opera22+Edge79+

Edge (Legacy)NoneIENone

Firefox for Android53+iOS SafariNoneChrome for Android35+Android WebView4.4.3+Samsung Internet3.0+Opera Mobile22+OfflineAudioContext(contextOptions) -

現在の設定オブジェクト に 対応するドキュメント が 完全にアクティブ でない場合は、

c を新しいInvalidStateErrorを発生して、これらの手順を中止します。OfflineAudioContextオブジェクトとします。 c は次のように初期化されます:-

c の

[[制御スレッドの状態]]を"suspended"にします。 -

c の

[[レンダリングスレッドの状態]]を"suspended"にします。 -

channelCountをcontextOptions.numberOfChannelsとしたAudioDestinationNodeを作成します。

OfflineAudioContext.constructor(contextOptions) メソッドの引数 パラメーター 型 Null可 省略可 説明 contextOptionsこのコンテキストを作成する際に必要な初期化パラメーター -

OfflineAudioContext(numberOfChannels, length, sampleRate)-

OfflineAudioContextは AudioContext.createBuffer と同じ引数で作成できます。もし引数のどれかが負、0、または範囲外の場合はNotSupportedError例外を発生します ( MUST )。OfflineAudioContext は、次の呼び出し

new OfflineAudioContext({ numberOfChannels: numberOfChannels, length: length, sampleRate: sampleRate}) が行われたのと同じように作成されます。

OfflineAudioContext.constructor(numberOfChannels, length, sampleRate) メソッドの引数 パラメーター 型 Null可 省略可 説明 numberOfChannelsunsigned long ✘ ✘ バッファが持つチャンネルの数を指定します。サポートされているチャンネル数については、 createBuffer()を参照してください。lengthunsigned long ✘ ✘ バッファのサイズをサンプルフレーム数で指定します。 sampleRatefloat ✘ ✘ バッファ内の リニア PCM オーディオデータのサンプルレートをサンプルフレーム / 秒で記述します。有効なサンプルレートについては、 createBuffer()を参照してください。

1.3.2. 属性

-

FirefoxYesSafariNoneChrome51+

Opera38+Edge79+

Edge (Legacy)14+IENone

Firefox for AndroidYesiOS SafariNoneChrome for Android51+Android WebView51+Samsung Internet5.0+Opera Mobile41+length, unsigned long 型, readonly -

サンプルフレーム数で表したバッファのサイズです。これは、コンストラクタの

lengthパラメーターの値と同じです。 -

OfflineAudioContext/oncomplete

In all current engines.

Firefox25+Safari6+Chrome25+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari?Chrome for Android25+Android WebView37+Samsung Internet1.5+Opera Mobile14+oncomplete, EventHandler 型 -

OfflineAudioCompletionEvent 型の EventHandler です。これは

OfflineAudioContextで最後に発行されるイベントです。

1.3.3. メソッド

-

OfflineAudioContext/startRendering

In all current engines.

Firefox25+Safari6+Chrome25+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari?Chrome for Android25+Android WebView37+Samsung Internet1.5+Opera Mobile14+startRendering() -

与えられた現在の接続と変化のスケジュールで、オーディオのレンダリングを開始します。

レンダリングされたオーディオデータを取得する主な方法は、promise の戻り値を経由する方法ですが、インスタンスは歴史的な理由により、

completeという名前のイベントも発生させます。[[rendering started]]をこのOfflineAudioContextの内部スロットとします。 このスロットは false に初期化されます。startRenderingが呼び出されたとき、制御スレッド で次の手順を実行しなくてはなりません ( MUST ) :- this に 対応するグローバルオブジェクト に 関連付けられたドキュメント が 完全にアクティブ でない場合は、

InvalidStateErrorDOMExceptionで promise をリジェクト して返します。 OfflineAudioContextの[[rendering started]]スロットが true の場合、InvalidStateErrorでリジェクトした promise を返し、これらの手順を中止します。OfflineAudioContextの[[rendering started]]スロットを true に設定します。- promise を新しい Promise とします。

contextOptionsパラメーターでこのインスタンスのコンストラクタに渡されたnumberOfChannels、length、およびsampleRateの値にそれぞれ等しいチャンネル数、長さ、およびサンプルレートを持つ、新しいAudioBufferを作成します。このバッファをOfflineAudioContextの内部スロット[[rendered buffer]]に割り当てます。- 前項の

AudioBufferコンストラクタ呼び出し中に例外が発生した場合、この例外を持って promise をリジェクトします。 - そうでなく、バッファが正常に作成された場合は、オフラインレンダリングを開始 します。

- promise を

[[pending promises]]に追加します。 - promise を返します。

オフラインレンダリングを開始 するには、その際に作成された レンダリングスレッド で次の手順が実行されなくてはなりません ( MUST )。- 現在の接続と変化のスケジュールが与えられたら、

length長のオーディオのサンプルフレームを[[rendered buffer]]にレンダリングし始めます。 - レンダリング量子 ごとにチェックを行い、必要ならば

suspendします。 - もしサスペンドされていたコンテキストが再開された場合、バッファへのレンダリングを継続します。

- レンダリングが完了したら、次の手順を実行する メディア要素タスクをキューに入れます:

startRendering()によって作成された promise を[[rendered buffer]]をもってリゾルブします。OfflineAudioCompletionEventのインスタンスのrenderedBufferプロパティに[[rendered buffer]]を設定し、completeという名前の イベントを発行 する メディア要素タスクをキューに入れます。

パラメーターなし。戻り値:Promise<AudioBuffer> - this に 対応するグローバルオブジェクト に 関連付けられたドキュメント が 完全にアクティブ でない場合は、

-

In only one current engine.

FirefoxNoneSafariNoneChrome49+

Opera36+Edge79+

Edge (Legacy)18IENone

Firefox for AndroidNoneiOS SafariNoneChrome for Android49+Android WebView49+Samsung Internet5.0+Opera Mobile36+resume() -

OfflineAudioContextがサスペンドされていた場合、そのcurrentTimeの進行を再開します。resume が呼び出された場合これらの手順を実行します:-

this に 対応するグローバルオブジェクト に 関連付けられたドキュメント が 完全にアクティブ でない場合は、

InvalidStateErrorDOMExceptionで promise をリジェクト して返します。 -

promise を新しい Promise とします。

-

次の条件が真となった場合、これらの手順を中止し promise を

InvalidStateErrorでリジェクトします :-

OfflineAudioContextの[[制御スレッドの状態]]がclosedになった。 -

OfflineAudioContextの[[rendering started]]スロットが false になった。

-

-

OfflineAudioContextの[[制御スレッドの状態]]フラグをrunningに設定します。 -

OfflineAudioContextを再開させるための 制御メッセージをキューに入れます。 -

promise を返します。

OfflineAudioContextを再開する 制御メッセージ を実行するとは、以下の手順を レンダリングスレッド で実行する事を意味します :-

OfflineAudioContextの[[制御スレッドの状態]]をrunningに設定します。 -

オーディオグラフのレンダリング を開始します。

-

失敗した場合は promise をリジェクトする メディア要素タスクをキューに入れ、残りの手順を中止します :

-

以下の手順を実行する メディア要素タスクをキューに入れます :

-

promise をリゾルブします。

-

もし

OfflineAudioContextのstate属性が既に "running" でない場合 :-

OfflineAudioContextのstate属性を "running" に設定します。 -

OfflineAudioContext上でstatechangeという名前の イベントを発行 するための メディア要素タスクをキューに入れます。

-

-

パラメーターなし。 -

-

In only one current engine.

FirefoxNoneSafariNoneChrome49+

Opera36+Edge79+

Edge (Legacy)18IENone

Firefox for AndroidNoneiOS SafariNoneChrome for Android49+Android WebView49+Samsung Internet5.0+Opera Mobile36+suspend(suspendTime) -

指定された時刻にオーディオコンテキストの時間進行の停止をスケジュールし、promise を返します。これは一般的に、

OfflineAudioContextでオーディオグラフを同期して操作する場合に有用です。サスペンドの最大の精度は レンダリング量子 のサイズであり、指定されたサスペンドの時刻は最も近い レンダリング量子 の境界に丸められることに注意してください。このため、同じ量子化されたフレーム内で複数のサスペンドをスケジュールすることはできません。また精度の高いサスペンドを確実に行うには、コンテキストが動作中でない間にスケジューリングを行う必要があります。

OfflineAudioContext.suspend() メソッドの引数 パラメーター 型 Null可 省略可 説明 suspendTimedouble ✘ ✘ 指定された時刻にレンダリングのサスペンドをスケジューリングします。時刻は レンダリング量子 のサイズで量子化されて丸められます。 量子化されたフレーム番号が - 負の値、または

- 現在の時刻より小さいか同じ、または

- レンダリング全体の長さより大きいか同じ、または

- 同じ時刻に別のサスペンドがスケジュールされている

InvalidStateErrorでリジェクトされます。

1.3.4. OfflineAudioContextOptions

これは OfflineAudioContext の作成の際に使用するオプションを指定します。

dictionary {OfflineAudioContextOptions unsigned long numberOfChannels = 1;required unsigned long length ;required float sampleRate ; };

1.3.4.1. ディクショナリー OfflineAudioContextOptions メンバー

length, unsigned long 型-

サンプルフレーム数で表したレンダリングされる

AudioBufferの長さ。 numberOfChannels, unsigned long 型, デフォルト値は1-

この

OfflineAudioContextのチャンネル数。 sampleRate, float 型-

この

OfflineAudioContextのサンプルレート。

1.3.5. OfflineAudioCompletionEvent インターフェース

In all current engines.

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+

OfflineAudioContext/complete_event

In all current engines.

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari?Chrome for Android25+Android WebView37+Samsung Internet1.5+Opera Mobile14+

これは、歴史的な理由から OfflineAudioContext に発行される Event オブジェクトです。

OfflineAudioCompletionEvent/OfflineAudioCompletionEvent

In all current engines.

Opera42+Edge79+

Edge (Legacy)NoneIENone

Firefox for Android53+iOS SafariYesChrome for Android57+Android WebView57+Samsung Internet6.0+Opera Mobile42+

[Exposed =Window ]interface :OfflineAudioCompletionEvent Event {(constructor DOMString ,type OfflineAudioCompletionEventInit );eventInitDict readonly attribute AudioBuffer renderedBuffer ; };

1.3.5.1. 属性

-

OfflineAudioCompletionEvent/renderedBuffer

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+renderedBuffer, AudioBuffer 型, readonly -

レンダリングしたオーディオデータを保持する

AudioBufferです。

1.3.5.2. OfflineAudioCompletionEventInit

dictionary :OfflineAudioCompletionEventInit EventInit {required AudioBuffer renderedBuffer ; };

1.3.5.2.1. ディクショナリー OfflineAudioCompletionEventInit メンバー

renderedBuffer, AudioBuffer 型-

イベントの

renderedBuffer属性に割り当てる値。

1.4. AudioBuffer インターフェース

Opera42+Edge79+

Edge (Legacy)NoneIENone

Firefox for Android53+iOS SafariNoneChrome for Android55+Android WebView55+Samsung Internet6.0+Opera Mobile42+

このインターフェースは、メモリー上にあるオーディオデータを表します。そのフォーマットはノンインタリーブな 32 ビットの浮動小数点の リニア PCM で、通常は \([-1,1]\) の範囲になりますが、値はこの範囲に限定はされません。通常、PCM データの長さはかなり短く ( 通常は 1 分未満 ) と想定されています。音楽サウンドトラックなどのより長いサウンドの場合、audio 要素と MediaElementAudioSourceNode によるストリーミングを使うべきです。

AudioBuffer は、1 つ以上の AudioContext によって使用され、OfflineAudioContext と AudioContext の間で共有する事もできます。

AudioBuffer には 4 つの内部スロットがあります:

[[number of channels]]-

この

AudioBufferのオーディオチャンネルの数、符号なし long 型です。 [[length]]-

この

AudioBufferの各チャンネルの長さ、符号なし long 型です。 [[sample rate]]-

Hz で表した

AudioBufferのサンプルレート、float 型です。 [[internal data]]-

オーディオのサンプルデータを保持する データブロック です。

In all current engines.

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+

[Exposed =Window ]interface {AudioBuffer constructor (AudioBufferOptions );options readonly attribute float sampleRate ;readonly attribute unsigned long length ;readonly attribute double duration ;readonly attribute unsigned long numberOfChannels ;Float32Array getChannelData (unsigned long );channel undefined copyFromChannel (Float32Array ,destination unsigned long ,channelNumber optional unsigned long = 0);bufferOffset undefined copyToChannel (Float32Array ,source unsigned long ,channelNumber optional unsigned long = 0); };bufferOffset

1.4.1. コンストラクター

AudioBuffer(options)-

-

optionsの値のいずれかが公称範囲外にある場合は、NotSupportedError例外を発生し、以下の手順を中止します。 -

b を新しい

AudioBufferオブジェクトとします。 -

コンストラクタで渡された

AudioBufferOptionsの属性numberOfChannels、length、sampleRateの値をそれぞれ内部スロット[[number of channels]]、[[length]]、[[sample rate]]に割り当てます。 -

この

AudioBufferの内部スロット[[internal data]]をCreateByteDataBlock(を呼び出した結果に設定します。[[length]]*[[number of channels]])注 : これは、下層にある記憶域をゼロに初期化します。

-

b を返します。

AudioBuffer.constructor() メソッドの引数 パラメーター 型 Null可 省略可 説明 optionsAudioBufferOptions ✘ ✘ AudioBufferOptionsはこのAudioBufferのプロパティを決定します。 -

1.4.2. 属性

-

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+duration, double 型, readonly -

PCM オーディオデータの長さで、単位は秒です。

これは

[[sample rate]]とAudioBufferの[[length]]から計算され、[[length]]を[[sample rate]]で割る事で求められます。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+length, unsigned long 型, readonly -

サンプルフレーム数で表した PCM オーディオデータの長さです。これは

[[length]]の値を返さなければなりません ( MUST )。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+numberOfChannels, unsigned long 型, readonly -

個別のオーディオチャンネルの数です。これは

[[number of channels]]の値を返さなければなりません ( MUST )。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+sampleRate, float 型, readonly -

サンプル / 秒で表した PCM オーディオデータのサンプルレートです。これは、

[[sample rate]]の値を返さなければなりません ( MUST )。

1.4.3. メソッド

-

Firefox25+SafariNoneChrome43+

Opera30+Edge79+

Edge (Legacy)13+IENone

Firefox for Android25+iOS SafariNoneChrome for Android43+Android WebView43+Samsung Internet4.0+Opera Mobile30+copyFromChannel(destination, channelNumber, bufferOffset) -

copyFromChannel()メソッドは、AudioBufferの指定されたチャンネルからサンプルをdestinationの配列にコピーします。bufferを \(N_b\) フレームのAudioBufferとし、\(N_f\) をdestination配列の要素数とし、\(k\) をbufferOffsetの値とします。このとき、bufferからdestinationにコピーされるフレームの数は \(\max(0, \min(N_b - k, N_f))\) となります。もしこれが \(N_f\) より小さい場合、destinationの残りの要素は変更されません。AudioBuffer.copyFromChannel() メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationFloat32Array ✘ ✘ チャンネルデータがコピーされる配列です。 channelNumberunsigned long ✘ ✘ データをコピーするチャンネルのインデックスです。 channelNumberがAudioBufferのチャンネル数と同じか大きい場合、IndexSizeError例外を発生します ( MUST )。bufferOffsetunsigned long ✘ ✔ オプションのオフセットで、デフォルトは 0 です。 AudioBufferのこのオフセットから始まるデータがdestinationにコピーされます。戻り値:undefined -

Firefox25+SafariNoneChrome43+

Opera30+Edge79+

Edge (Legacy)13+IENone

Firefox for Android25+iOS SafariNoneChrome for Android43+Android WebView43+Samsung Internet4.0+Opera Mobile30+copyToChannel(source, channelNumber, bufferOffset) -

copyToChannel()メソッドは、source配列からAudioBufferの指定されたチャンネルにサンプルをコピーします。もし、

sourceがバッファにコピーできない場合はUnknownErrorを発生する事があります。bufferを \(N_b\) フレームのAudioBufferとし \(N_f\) をsource配列の要素数とし、\(k\) をbufferOffsetの値とします。このとき、sourceからbufferにコピーされるフレームの数は \(\max(0, \min(N_b - k, N_f))\) となります。これが \(N_f\) より小さい場合、bufferの残りの要素は変更されません。AudioBuffer.copyToChannel() メソッドの引数 パラメーター 型 Null可 省略可 説明 sourceFloat32Array ✘ ✘ チャンネルデータがコピーされる元の配列です。 channelNumberunsigned long ✘ ✘ データをコピーする先のチャンネルのインデックスです。もし channelNumberがAudioBufferのチャンネル数より大きいか同じ場合、IndexSizeErrorを発生します ( MUST )。bufferOffsetunsigned long ✘ ✔ データをコピーする先を示すオプションのオフセットで、デフォルトは 0 です。 sourceからのデータがAudioBufferのこのオフセットから始まる場所にコピーされます。戻り値:undefined -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS Safari6+Chrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+getChannelData(channel) -

コンテンツの取得 で説明されているルールに従って、新しい

Float32Arrayの[[internal data]]に格納されているバイトの 参照を取得 または バイトの コピーを取得 します。もし、

[[internal data]](訳注: の読み出し) または新しいFloat32Arrayの作成ができなかった場合は、UnknownErrorを発生する事があります。AudioBuffer.getChannelData() メソッドの引数 パラメーター 型 Null可 省略可 説明 channelunsigned long ✘ ✘ このパラメーターは、データを取得する特定のチャンネルを表すインデックスです。インデックス値 0 は最初のチャンネルを表します。このインデックス値は [[number of channels]]より小さくなくてはならず ( MUST )、そうでない場合はIndexSizeError例外を発生します ( MUST )。戻り値:Float32Array

注 : copyToChannel() と copyFromChannel() メソッドはより大きな配列のビューである Float32Array を渡す事で配列の一部だけを埋めるのに使用できます。 AudioBuffer のチャンネルからデータを読み取って塊りとして処理する場合、不要なメモリの割り当てとコピーを回避するため、 getChannelData() を呼び出して結果の配列にアクセスするよりも、 code class="idl">copyFromChannel() をお勧めします。

APIの実装が AudioBuffer の内容が必要になったとき、 AudioBuffer の内容の取得 という内部処理が起動されます。この処理は呼び出し元に変更不能なチャンネルデータを返します。

AudioBuffer の 内容の取得 処理が発生した場合は次の手順で実行されます:

-

AudioBufferのArrayBufferの一部でもIsDetachedBuffer処理に対してtrueを返した場合、これらの手順を中止し、呼び出し元に長さ 0 のチャンネルデータバッファを返します。 -

この

AudioBufferのgetChannelData()によってこれまでに返された配列のすべてのArrayBufferを デタッチ します。注 :

AudioBufferはcreateBuffer()またはAudioBufferコンストラクターを介してのみ作成できるため、これは例外を起こしません。 -

これらの

ArrayBufferの下層にある[[internal data]]を保持したまま、それらへの参照を呼び出し側に返します。 -

AudioBufferのデータのコピーを保持するArrayBufferをアタッチして次回のgetChannelData()の呼び出しで返せるようにします。

AudioBuffer の内容の取得 処理は、次の場合に呼び出されます:

-

AudioBufferSourceNode.startが呼び出されると、ノードのbufferの 内容の取得 を行います。この処理が失敗した場合は何も再生されません。 -

AudioBufferSourceNode.startがあらかじめ呼び出されている状態で、AudioBufferSourceNodeのbufferが設定されたとき、その設定処理がAudioBufferの 内容の取得 を行います。この処理が失敗した場合、何も再生されません。 -

ConvolverNodeのbufferがあるAudioBufferに設定された時、そのAudioBufferの 内容の取得 が行われます。 -

AudioProcessingEventのディスパッチが完了すると、そのoutputBufferの 内容の取得 が行われます。

注 : これは copyToChannel() は現在 AudioNode が AudioBuffer の内容を取得 して使用中の AudioBuffer の内容を変更するためには使えない事を意味します。 AudioNode は以前に取得したデータを使い続けます。

1.4.4. AudioBufferOptions

これは AudioBuffer の作成に使用するオプションを指定します。 length と sampleRate メンバーは必須です。

dictionary {AudioBufferOptions unsigned long numberOfChannels = 1;required unsigned long length ;required float sampleRate ; };

1.4.4.1. ディクショナリー AudioBufferOptions メンバー

このディクショナリーのメンバーが取れる値には制約があります。 createBuffer() を参照してください。

length, unsigned long 型-

サンプルフレーム数で表されるバッファの長さです。制約については

lengthを参照してください。 numberOfChannels, unsigned long 型, デフォルト値は1-

バッファのチャンネル数です。制約については

numberOfChannelsを参照してください。 sampleRate, float 型-

Hz で表されるバッファのサンプルレートです。制約については

sampleRateを参照してください。

1.5. AudioNode インターフェース

AudioNode は AudioContext を構成するブロックです。このインターフェースは、音源、音の出力先、および中間の処理モジュールを表しています。これらのモジュールは互いに接続されて、音をオーディオハードウェアに出力するための 処理グラフ を形成します。それぞれのノードは 入力 や 出力 を持つ事ができます。 ソースノード は入力を持たず、単一の出力を持ちます。フィルターのようなほとんどの処理ノードは、1 つの入力と 1 つの出力を持ちます。それぞれのタイプの AudioNode はどのようにオーディオを処理したり合成するのかの詳細が異なっています。しかし一般的に AudioNode は ( 持っていれば ) 入力を処理し、( 持っていれば ) その出力にオーディオ信号を送り出します。

それぞれの出力は 1 つ以上のチャンネルを持っています。正確なチャンネル数はそれぞれの AudioNode の詳細に依存します。

出力は 1 つ以上の AudioNode の入力に接続でき、つまり ファンアウト がサポートされています。入力は初期状態では接続されていません。しかし、1 つ以上の AudioNode の出力から接続する事ができ、即ち、ファンイン がサポートされています。 AudioNode の出力を AudioNode の入力に接続するため connect() メソッドが呼ばれたとき、それをその入力への 接続 と呼びます。

各 AudioNode の 入力 はその時々で特定のチャンネル数を持ちます。この数はその入力への 接続 によって変化します。もし入力が接続を持っていない場合、チャンネル数は 1 で無音となります。

AudioNode は 各々の 入力 について、その入力へのすべての接続のミキシングを行います。この詳細な基準となる要件については § 4 チャンネルのアップミックスとダウンミックス セクションを参照してください。

AudioNode の入力および内部の処理は、そのノードが出力を接続されているか、またそれらの出力が AudioContext の AudioDestinationNode に最終的に到達しているかどうかに関わらず、 AudioContext の時刻を踏まえて継続的に行われます。

In all current engines.

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+

[Exposed =Window ]interface :AudioNode EventTarget {AudioNode connect (AudioNode destinationNode ,optional unsigned long output = 0,optional unsigned long input = 0);undefined connect (AudioParam destinationParam ,optional unsigned long output = 0);undefined disconnect ();undefined disconnect (unsigned long output );undefined disconnect (AudioNode destinationNode );undefined disconnect (AudioNode destinationNode ,unsigned long output );undefined disconnect (AudioNode destinationNode ,unsigned long output ,unsigned long input );undefined disconnect (AudioParam destinationParam );undefined disconnect (AudioParam destinationParam ,unsigned long output );readonly attribute BaseAudioContext context ;readonly attribute unsigned long numberOfInputs ;readonly attribute unsigned long numberOfOutputs ;attribute unsigned long channelCount ;attribute ChannelCountMode channelCountMode ;attribute ChannelInterpretation channelInterpretation ; };

1.5.1. AudioNode の作成

AudioNode の作成には 2 つの方法があります: 特定のインターフェースのコンストラクタを使用する方法、と BaseAudioContext または AudioContext の ファクトリーメソッド を使用する方法です。

AudioNode のコンストラクタの最初の引数として渡される BaseAudioContext は、作成される AudioNode が 関連する BaseAudioContext と呼ばれます。同様に、ファクトリーメソッドを使用する場合、 AudioNode の 関連する BaseAudioContext は このファクトリーメソッドが呼び出される BaseAudioContext です。

BaseAudioContext c 上の ファクトリーメソッド の呼び出しにより、特定のタイプ n の新しい AudioNode を作成するには、次の手順を実行します:

-

node を型 n の新しいオブジェクトとします。

-

option を、このファクトリーメソッドに 対応する インターフェースに 関連付け られた型のディクショナリーとします。

-

ファクトリーメソッドに渡される各パラメーターについて、 option 内の名前が一致するディクショナリーメンバーをこのパラメーターの値に設定します。

-

node の作成のために c と option を引数として n の コンストラクターを呼び出します。

-

node を返します。

AudioNode から継承したオブジェクト o を 初期化 する事は、このインターフェースのコンストラクタに引数 context と dict を渡して、次の手順を実行することを意味します。

-

context を o が関連付けられた

BaseAudioContextとします。 -

numberOfInputs、numberOfOutputs、channelCount、channelCountMode、channelInterpretationの値を、各AudioNodeのセクションで説明するそれぞれのインターフェースのデフォルト値に設定します。 -

渡された dict のそれぞれのメンバーについて、k をメンバーのキー、v をその値として以下の手順を実行します。手順の実行の際に何らかの例外が発生した場合は反復処理を中止し、例外をアルゴリズムの呼び出し元 ( コンストラクターまたはファクトリーメソッド ) に伝えます。

-

k がこのインターフェースの

AudioParamの名前である場合、このAudioParamのvalue属性を v に設定します。 -

そうでなく、k がこのインターフェースの属性の名前である場合、この属性に関連付けられたオブジェクトを v に設定します。

-

ファクトリーメソッドに 関連するインターフェース は、このメソッドから返されるオブジェクトのインターフェースです。インターフェースに 関連するオプションオブジェクト は、このインターフェースのコンストラクタに渡すことができるオプションオブジェクトです。

AudioNode は [DOM] で説明されているように EventTarget です。つまり、他の EventTarget がイベントを受け入れるのと同じ方法で、イベントを AudioNode にディスパッチすることができます。

enum {ChannelCountMode "max" ,"clamped-max" ,"explicit" };

ChannelCountMode は、ノードの channelCount および channelInterpretation の値と組み合わせて、ノードへの入力をどのようにミックスするかを制御する computedNumberOfChannels を決定するために使用されます。 computedNumberOfChannels は次のように決定されます。ミックスがどのように行われるかの詳細については、§ 4 チャンネルのアップミックスとダウンミックス を参照してください。

| 列挙値の説明 | |

|---|---|

"max"

| computedNumberOfChannels は入力となっている全接続のチャンネル数の最大値になります。このモードでは channelCount は無視されます。

|

"clamped-max"

| computedNumberOfChannels は "max" のときと同じように計算されますが、指定された channelCount を上限に制限されます。

|

"explicit"

| computedNumberOfChannels の値は channelCount によって指定された値そのものになります。

|

enum {ChannelInterpretation "speakers" ,"discrete" };

| 列挙値の説明 | |

|---|---|

"speakers"

| アップミックス式 または ダウンミックス式 を使用します。チャンネル数がスピーカーの基本レイアウトに合致しない場合は、"discrete" に戻します。

|

"discrete"

| アップミックスの場合は、チャンネルを使い切るまで順に埋めて行き、余っているチャンネルには 0 を出力します。ダウンミックスでは、可能な限りチャンネルを順に埋め、余ったチャンネルは捨てられます。 |

1.5.2. AudioNode のテールタイム

AudioNode は テールタイム を持つことができます。 これは AudioNode に無音が供給されている場合でも、出力が無音では無い可能性があることを意味します。

AudioNode は過去の入力が将来の出力に影響するような内部処理状態を持っている場合、非ゼロのテールタイムを持っています。 AudioNode は、入力が音のある状態から無音に移行した後でも、計算されたテールタイムの間、音を出力し続ける場合があります。

1.5.3. AudioNode のライフタイム

AudioNode は次のいずれかの条件が満たされている場合、 レンダリング量子 の間 アクティブに処理 を続けます。

-

AudioScheduledSourceNodeは現在のレンダリング量子の少なくとも一部で 再生 されている場合にのみ アクティブに処理 されます。 -

MediaElementAudioSourceNodeはそのmediaElementが現在のレンダリング量子の少なくとも一部で再生されている場合にのみ アクティブに処理 されます。 -

MediaStreamAudioSourceNodeまたはMediaStreamTrackAudioSourceNodeは関連付けられているMediaStreamTrackオブジェクトのreadyState属性が"live"で、muted属性がfalseで、enabled属性がtrueである場合に アクティブに処理 されます。 -

循環の中に入っている

DelayNodeは現在の レンダリング量子 の出力サンプルの絶対値が \( 2^{-126} \) 以上の場合にのみ アクティブに処理 されます。 -

ScriptProcessorNodeは、その入力または出力が接続されている場合に アクティブに処理 されます。 -

AudioWorkletNodeはAudioWorkletProcessorの[[callable process]]がtrueを返して、active source フラグがtrueであるか、入力のどれかに接続されているAudioNodeが アクティブに処理 している場合に アクティブに処理 されます。 -

他のすべての

AudioNodeは、その入力のどれかに接続されたAudioNodeが アクティブに処理 を行っているのであれば アクティブな処理 を開始し、他の アクティブに処理 を行っているAudioNodeから受け取った入力が出力に影響を与えなくなったときに アクティブな処理 を停止します。

注 : これは AudioNode が テールタイム を持つ事を考慮に入れます。

アクティブに処理 を行っていない AudioNode は 1 チャンネルの無音を出力します。

1.5.4. 属性

-

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+channelCount, unsigned long 型 -

channelCountはノードへの入力の接続におけるアップミックスおよびダウンミックスの際に使用されるチャンネル数です。値が別途定められている特定のノードを除いて、デフォルトは 2 です。この属性は入力を持たないノードでは意味を持ちません。もしこの値が 0、あるいは実装のチャンネル数の最大値より大きい値にセットされた場合、NotSupportedError例外を発生します ( MUST )。さらに、一部のノードではこれに加えて チャンネル数の制約 があります:

AudioDestinationNode-

この動作は、接続先のデスティネーションノードが

AudioContextかOfflineAudioContextかによって異なります:AudioContext-

チャンネル数は 1 から

maxChannelCountの間でなければなりません ( MUST )。この範囲外の値を設定しようとすると、IndexSizeError例外を発生します ( MUST )。 OfflineAudioContext-

チャンネル数を変更することはできません。値を変更しようとすると

InvalidStateError例外を発生します ( MUST )。

AudioWorkletNode-

§ 1.32.3.3.2 AudioWorkletNodeOptions によるチャンネルの設定 の AudioWorkletNodeOptions によるチャンネル設定を参照してください。

ChannelMergerNode-

チャンネル数を変更することはできません。値を変更しようとすると

InvalidStateError例外を発生します ( MUST )。 ChannelSplitterNode-

チャンネル数を変更することはできません。値を変更しようとすると

InvalidStateError例外を発生します ( MUST )。 ConvolverNode-

チャンネル数は 2 より大きくできません。2 より大きい値を設定しようとすると

NotSupportedError例外を発生します ( MUST )。 DynamicsCompressorNode-

チャンネル数は 2 より大きい値にはできません。2 より大きい値に変更しようとすると

NotSupportedError例外を発生します ( MUST )。 PannerNode-

チャンネル数は 2 より大きくすることはできません。2 より大きな値に変更しようとすると

NotSupportedError例外を発生します ( MUST )。 ScriptProcessorNode-

チャンネル数は変更することができません。変更しようとすると

NotSupportedError例外を発生します ( MUST )。 StereoPannerNode-

チャンネル数は 2 より大きくすることはできません。2 より大きな値に変更しようとすると

NotSupportedError例外を発生します ( MUST )。

この属性の詳細については、§ 4 チャンネルのアップミックスとダウンミックス を参照してください。

-

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+channelCountMode, ChannelCountMode 型 -

channelCountModeは、ノードの入力への接続をアップミックスおよびダウンミックスするときに、チャンネルがどのようにカウントされるかを決定します。デフォルト値は "max" です。この属性は、入力のないノードには影響しません。さらに、一部のノードでは、チャンネル数モードが取れる値について channelCountMode の制約 があります:

AudioDestinationNode-

AudioDestinationNodeがOfflineAudioContextのdestinationノードである場合、チャンネル数モードは変更できません。値を変更しようとするとInvalidStateError例外を発生します ( MUST )。 ChannelMergerNode-

チャンネル数モードは "

explicit" から変更できません。値を変更しようとするとInvalidStateError例外を発生します ( MUST )。 ChannelSplitterNode-

チャンネル数モードは "

explicit" から変更できません。値を変更しようとするとInvalidStateError例外を発生します ( MUST )。 ConvolverNode-

チャンネル数モードは "

max" に設定する事はできません。値を "max" に設定しようとするとNotSupportedError例外を発生します ( MUST )。 DynamicsCompressorNode-

チャンネル数モードは "

max" に設定する事はできません。値を "max" に設定しようとするとNotSupportedError例外を発生します ( MUST )。 PannerNode-

チャンネル数モードは "

max" に設定する事はできません。値を "max" に設定しようとするとNotSupportedError例外を発生します ( MUST )。 ScriptProcessorNode-

チャンネル数モードは "

explicit" から変更できません。値を変更しようとするとNotSupportedError例外を発生します ( MUST )。 StereoPannerNode-

チャンネル数モードは "

max" に設定する事はできません。値を "max" に設定しようとするとNotSupportedError例外を発生します ( MUST )。

この属性の詳細については、§ 4 チャンネルのアップミックスとダウンミックス を参照してください。

-

AudioNode/channelInterpretation

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+channelInterpretation, ChannelInterpretation 型 -

channelInterpretationは、ノードの入力への接続をアップミックスまたはダウンミックスするときに、個々のチャンネルをどのように扱うかを決定します。デフォルト値は "speakers" です。この属性は、入力のないノードには影響しません。さらに、一部のノードでは、チャンネルの解釈として取れる値に追加の channelInterpretation の制約 があります :

ChannelSplitterNode-

チャンネルの解釈は "

discrete" から変更することはできません。値を変更しようとするとInvalidStateError例外を発生します ( MUST )。

この属性の詳細については、§ 4 チャンネルのアップミックスとダウンミックス を参照してください。

-

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+context, BaseAudioContext 型, readonly -

この

AudioNodeを所有するBaseAudioContextです。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+numberOfInputs, unsigned long 型, readonly -

この

AudioNodeの入力の数です。 ソースノード ではこれは 0 になります。この属性は多くのAudioNodeのタイプであらかじめ決められていますが、ChannelMergerNodeやAudioWorkletNodeのようないくつかのAudioNodeでは入力の数は可変です。 -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+numberOfOutputs, unsigned long 型, readonly -

この

AudioNodeから出る出力の数です。この属性はいくつかのAudioNodeではあらかじめ決められた値ですが、ChannelSplitterNodeやAudioWorkletNodeなどでは可変になります。

1.5.5. メソッド

-

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+connect(destinationNode, output, input) -

あるノードの特定の出力から別のノードの特定の入力への接続は 1 つだけ存在できます。同じ端子間の複数回の接続は無視されます。

このメソッドは、

destinationのAudioNodeオブジェクトを返します。AudioNode.connect(destinationNode, output, input) メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationNodedestinationパラメーターは接続先のAudioNodeです。もしdestinationが他のAudioContextによって作成されたAudioNodeの場合、InvalidAccessError例外を発生します ( MUST )。つまりAudioNodeは複数のAudioContext間で共有する事はできません。チャンネルのアップミックスとダウンミックス で説明されているように複数のAudioNodeが同じAudioNodeに接続する事はできます。outputunsigned long ✘ ✔ outputパラメーターはAudioNodeのどの出力から接続するかを指定するインデックスです。もしこのパラメーターが範囲外の場合、IndexSizeError例外を発生します ( MUST )。 connect() を複数回呼び出してAudioNodeの出力から複数の入力に接続する事は可能です。つまり、"ファンアウト"がサポートされています。inputinputパラメーターは接続先のAudioNodeのどの入力に接続するかを指定するインデックスです。もしこのパラメーターが範囲外の場合、IndexSizeError例外を発生します ( MUST )。 あるAudioNodeから他のAudioNodeに 循環 を作るような接続を行う事も可能です: つまりあるAudioNodeから、最初のAudioNodeの入力かAudioParamに接続を行っている別のAudioNodeに対して接続を行う事ができます。戻り値:AudioNode -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+connect(destinationParam, output) -

AudioNodeをAudioParamに接続し、パラメーターの値を a-rate の信号で制御します。connect() を複数回呼び出す事で、1 つの

AudioNodeの出力を複数のAudioParamに接続する事が可能です。即ち "ファンアウト" がサポートされています。connect() を複数回呼び出す事で、複数の

AudioNodeを 1 つのAudioParamに接続する事が可能です。即ち "ファンイン" がサポートされています。code class="idl">AudioParam はそれに接続されている すべての

AudioNodeの出力からレンダリングされたオーディオデータを取り出し、それがモノラルでなければ、ダウンミックスによって モノラルに変換 します。そして接続されている各出力をミックスし、さらに最終的にパラメーターが持っているタイムラインの変化スケジュールを含む 固有値 (AudioParamに何も接続されていない状態でのvalue) とミックスします。モノラルへのダウンミックスは、

channelCount= 1、channelCountMode= "explicit"、およびchannelInterpretation= "speakers" のAudioNodeのダウンミックスに相当します。特定のノードの出力と特定の

AudioParamの間の接続は 1 つのみ存在できます。同じ終端点を持つ複数の接続は無視されます。For example:nodeA

. connect( param); nodeA. connect( param); will have the same effect as

nodeA

. connect( param); AudioNode.connect(destinationParam, output) メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationParamAudioParam ✘ ✘ destinationパラメーターは接続先のAudioParamです。このメソッドはdestinationのAudioParamオブジェクトを返しません。destinationParamが属するAudioNodeを作成したBaseAudioContextと、このメソッドが呼び出されたAudioNodeを作成したBaseAudioContextが異なる場合、InvalidAccessError例外を発生します ( MUST )。outputunsigned long ✘ ✔ outputパラメーターはAudioNodeのどの出力から接続するかを指定するインデックスです。もしparameterが範囲外の場合、IndexSizeError例外を発生します ( MUST )。戻り値:undefined -

In all current engines.

Firefox25+Safari6+Chrome14+

Opera15+Edge79+

Edge (Legacy)12+IENone

Firefox for Android25+iOS SafariYesChrome for Android18+Android WebView37+Samsung Internet1.0+Opera Mobile14+disconnect() -

AudioNodeから出るすべての接続を切断します。Disconnects all outgoing connections from the

AudioNode.パラメーターなし。戻り値:undefined disconnect(output)-

AudioNodeの 1 つの出力から他のAudioNodeまたはAudioParamオブジェクトへの接続をすべて切断します。a data-link-type="idl" href="#dom-audionode-disconnect-output" id="ref-for-dom-audionode-disconnect-output①">AudioNode.disconnect(output) メソッドの引数 パラメーター 型 Null可 省略可 説明 outputunsigned long ✘ ✘ このパラメーターは接続を切る AudioNodeの出力のインデックスです。これは与えられた出力から出るすべての接続を切断します。もしこのパラメーターが範囲外の場合、IndexSizeError例外を発生します ( MUST )。戻り値:undefined disconnect(destinationNode)-

AudioNodeのすべての出力から特定の接続先となるAudioNodeに繋がる接続を切断します。AudioNode.disconnect(destinationNode) メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationNodedestinationNodeパラメーターは切断するAudioNodeです。これは与えられたdestinationNodeに対するすべての接続を切断します。もしdestinationNodeに対する接続がない場合、InvalidAccessError例外を発生します ( MUST )。戻り値:undefined disconnect(destinationNode, output)-

AudioNodeの特定の出力から特定の接続先AudioNode入力への接続を切断します。AudioNode.disconnect(destinationNode, output) メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationNodedestinationNodeパラメーターは切断するAudioNodeです。もし与えられた出力からdestinationNodeに対する接続がない場合、InvalidAccessError例外を発生します ( MUST )。outputunsigned long ✘ ✘ outputパラメーターは接続を切るAudioNodeの出力を表すインデックスです。もしこのパラメーターが範囲外の場合はIndexSizeError例外を発生します ( MUST )。戻り値:undefined disconnect(destinationNode, output, input)-

AudioNodeの特定の出力から 接続先AudioNodeの特定の入力への接続を切断します。AudioNode.disconnect(destinationNode, output, input) メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationNodedestinationNodeパラメーターは切断するAudioNodeです。 もし与えられた出力からdestinationNodeへの接続が存在しない場合、InvalidAccessError例外を発生します ( MUST )。outputunsigned long ✘ ✘ outputパラメーターは切断するAudioNodeの出力のインデックスです。もしこのパラメーターが範囲外の場合、IndexSizeError例外を発生します ( MUST )。inputinputパラメーターは切断する接続先AudioNodeの入力のインデックスです。もしこのパラメーターが範囲外の場合、IndexSizeError例外を発生します ( MUST )。戻り値:undefined disconnect(destinationParam)-

特定の接続先

AudioParamに繋がるAudioNodeのすべての出力を切断します。この操作によって、このAudioNodeからパラメーター値の計算への寄与は 0 となります。パラメーターの固有値はこの操作に影響されません。AudioNode.disconnect(destinationParam) メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationParamAudioParam ✘ ✘ destinationParamパラメーターは切断するAudioParamです。もしdestinationParamに対する接続がない場合はInvalidAccessError例外を発生します ( MUST )。戻り値:undefined disconnect(destinationParam, output)-

AudioNodeの特定の出力から特定のAudioParamへの接続を切断します。この操作によって、このAudioNodeからパラメーター値の計算への寄与は 0 となります。パラメーターの固有値はこの操作に影響されません。AudioNode.disconnect(destinationParam, output) メソッドの引数 パラメーター 型 Null可 省略可 説明 destinationParamAudioParam ✘ ✘ destinationParamパラメーターは切断されるAudioParamです。もしdestinationParamへの接続が存在しない場合、InvalidAccessError例外を発生します ( MUST )。outputunsigned long ✘ ✘ outputパラメーターは切断されるAudioNodeの出力のインデックスです。もしparameterが範囲外の場合、IndexSizeError例外を発生します ( MUST )。戻り値:undefined

1.5.6. AudioNodeOptions

これは、すべての AudioNode の生成の際に使用できるオプションを指定します。すべてのメンバーはオプションです。ただし、それぞれのノードで使われる値は、実際のノードに依存します。

Opera42+Edge79+

Edge (Legacy)NoneIENone

Firefox for Android53+iOS Safari?Chrome for Android55+Android WebView55+Samsung Internet6.0+Opera Mobile42+

dictionary {AudioNodeOptions unsigned long channelCount ;ChannelCountMode channelCountMode ;ChannelInterpretation channelInterpretation ; };

1.5.6.1. ディクショナリー AudioNodeOptions メンバー

channelCount, unsigned long 型-

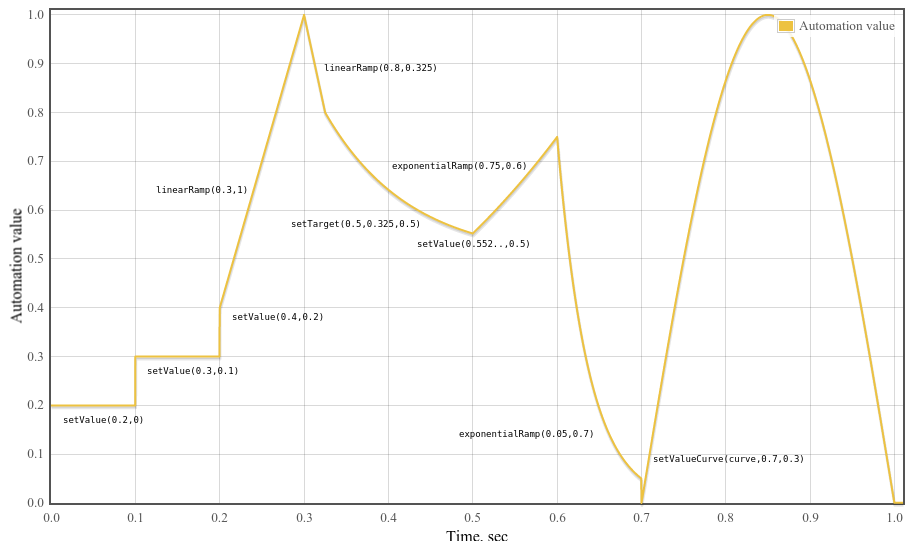

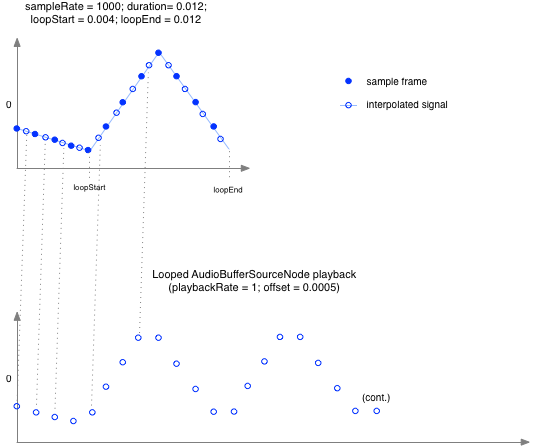

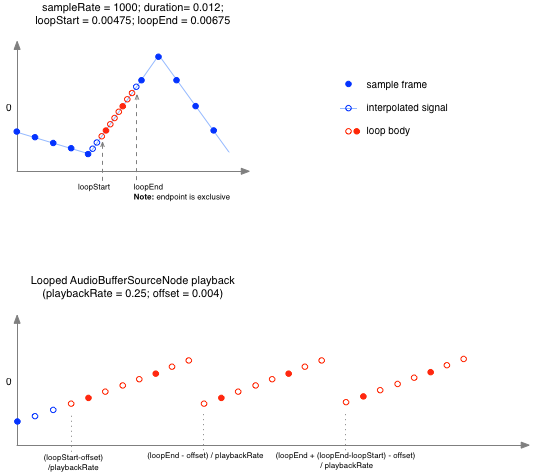

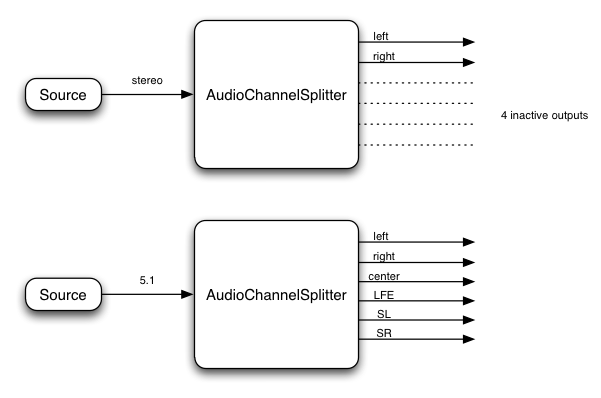

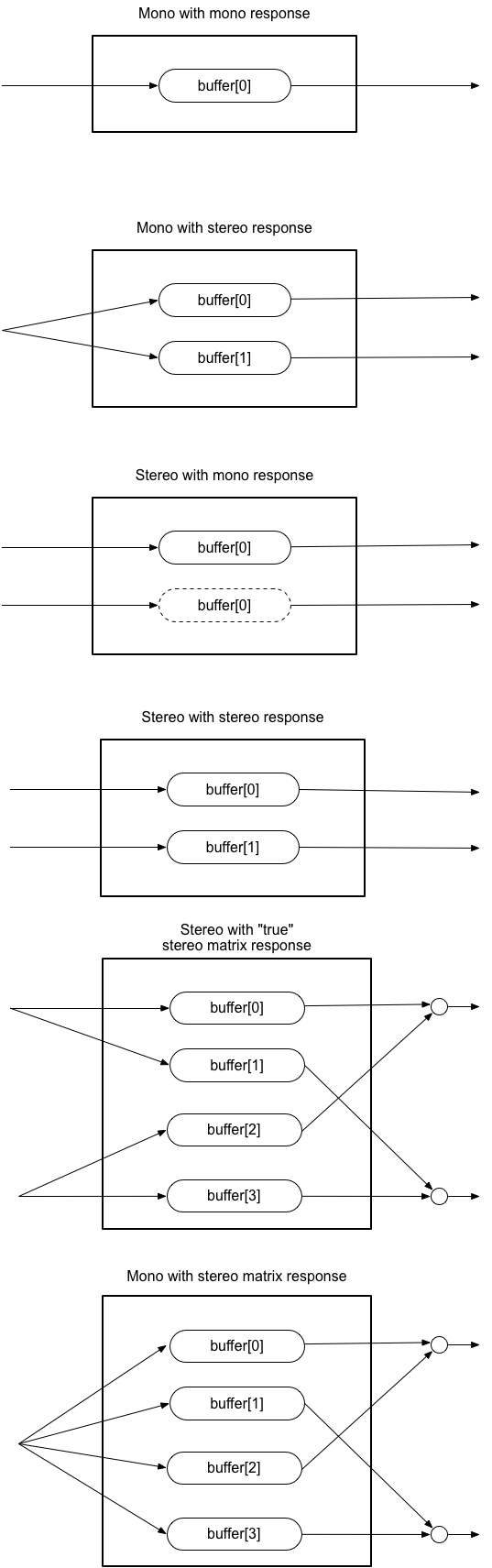

channelCount属性に要求するチャンネル数です。 channelCountMode, ChannelCountMode 型-